Sommaire

- 1 Amazon Lex et l’architecture NLU des Callbots AWS en Entreprise

- 2 Concevoir des intentions Amazon Lex pour automatiser le Service Client sans dégrader l’expérience

- 3 AWS Lambda, IAM et API : industrialiser un Callbot Amazon Lex dans le SI d’Entreprise

- 4 Reconnaissance Vocale, Polly, Connect : construire un callbot de bout en bout avec AWS

- 5 Gouvernance, coûts et conformité : réussir Amazon Lex pour des Callbots en Entreprise

- 5.1 Mesurer ce qui compte : du taux d’automatisation à la satisfaction

- 5.2 Encadrement des données : éviter les fuites par les logs et les traces

- 5.3 Ressources pratiques pour accélérer sans sacrifier la rigueur

- 5.4 Amazon Lex suffit-il à lui seul pour créer des callbots en entreprise ?

- 5.5 Quelle différence entre intentions, entités et slots dans Amazon Lex ?

- 5.6 Comment améliorer la reconnaissance vocale et éviter les incompréhensions au téléphone ?

- 5.7 Quelles bonnes pratiques sécurité pour un callbot AWS manipulant des données clients ?

En bref

- Amazon Lex apporte une brique de Reconnaissance Vocale et de compréhension du langage utile pour industrialiser des Callbots au sein d’une Entreprise, surtout quand l’écosystème AWS est déjà en place.

- La réussite passe par une conception méthodique : intentions (le “verbe” de l’utilisateur), slots (les “noms” à collecter), et un flux de dialogue robuste.

- Pour la logique métier, AWS Lambda devient le point d’ancrage : validation, orchestration, règles, appels SI, et gestion de l’état conversationnel.

- Les intégrations (Amazon Connect, Polly, stockage, CRM) transforment un bot de démonstration en canal d’Automatisation fiable pour le Service Client.

- Les limites se jouent souvent sur les entités “vraiment” contextuelles et la gouvernance des données ; une approche outillée (tests, monitoring, sécurité) évite les mauvaises surprises.

Un standard téléphonique qui décroche immédiatement, comprend des demandes naturelles et traite les cas simples sans attente n’est plus une promesse vague : c’est une interaction conversationnelle désormais accessible avec les bons choix d’architecture. Dans ce paysage, Amazon Lex s’impose comme une brique pragmatique pour construire des Chatbots et surtout des Callbots lorsqu’une Entreprise opère déjà sur AWS. L’intérêt n’est pas seulement de “faire parler un bot”, mais d’organiser un parcours fiable : détecter l’intention, collecter les informations indispensables, déclencher une action métier, puis sécuriser le tout (traçabilité, conformité, supervision).

Le sujet devient vite concret : comment gérer une demande de solde bancaire sans exposer de données sensibles ? Comment router un appel vers le bon service après une qualification automatique ? Comment éviter qu’un client répète trois fois son numéro de dossier ? Une démarche méthodique apporte des réponses, en combinant Intelligence Artificielle, orchestration serverless et intégrations SI. Et c’est précisément là que Lex, Lambda et l’écosystème AWS peuvent produire un callbot industriel, à condition de traiter sérieusement les intentions, les slots, la machine à états et les tests.

Amazon Lex et l’architecture NLU des Callbots AWS en Entreprise

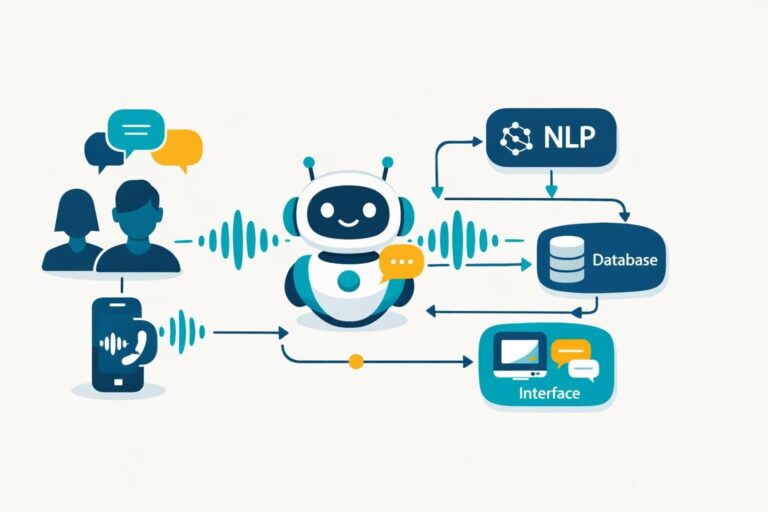

Amazon Lex s’inscrit dans l’architecture “classique” des plateformes de bots cloud : un moteur de compréhension (NLU) pour identifier ce que veut l’utilisateur, un modèle de données conversationnelles, puis une exécution (réponses, actions, intégrations) orchestrée par du code ou un gestionnaire de dialogue. Cette approche est largement partagée par les grands acteurs : l’objectif est de rendre la reconnaissance d’intention suffisamment fiable pour automatiser les demandes fréquentes, tout en laissant les cas complexes à l’humain.

Dans un contexte Entreprise, l’enjeu principal est d’obtenir une base stable et gouvernable. Un callbot qui “improvise” peut séduire en démo, mais dégrade vite le Service Client s’il comprend mal les variations d’expression, ou s’il ne sait pas gérer les digressions. Lex se positionne comme un socle robuste quand il est cadré : les intentions sont explicites, les slots sont imposés, et les réponses sont contrôlées. Cette contrainte, parfois perçue comme une rigidité, devient une force en production, car elle facilite les tests et la maîtrise du risque.

Intentions, slots, et flux : les trois piliers d’une interaction conversationnelle maîtrisée

Une intention peut être vue comme un verbe. “Ouvrir un compte”, “fermer un compte”, “connaître le solde”, “transférer de l’argent” : chaque demande type doit être modélisée comme une intention distincte, avec des exemples d’énoncés variés. Un callbot efficace ne dépend pas d’une phrase parfaite ; il doit reconnaître des formulations réalistes, y compris celles prononcées rapidement au téléphone.

Les slots (équivalent fonctionnel des “entités” dans d’autres environnements) sont les noms nécessaires à l’action : un montant, une date, une ville, un identifiant client, un motif. Lex gère correctement la collecte : priorité, caractère obligatoire, relances, confirmation. Cela permet de réduire les conversations incomplètes, typiques des parcours téléphoniques (“il manque le numéro de commande, impossible d’avancer”).

Enfin, le flux de dialogue se comporte comme une machine à états : le callbot doit savoir où il en est, ce qui a été confirmé, et ce qui reste à demander. Cette notion est fondamentale pour éviter les boucles et les pertes de contexte. Elle annonce naturellement la section suivante : la plupart des organisations externalisent cette orchestration dans AWS Lambda.

À retenir : Lex apporte une structure claire (intentions, slots, prompts), mais un callbot d’entreprise devient fiable quand le flux conversationnel est pensé comme un parcours contrôlé, pas comme une discussion libre.

Pour approfondir rapidement les bases et retrouver des exemples de configuration, une ressource pédagogique utile est ce tutoriel Amazon Lex orienté débutants, à compléter ensuite avec la documentation officielle quand le projet passe en production.

Tester AirAgent gratuitement · Sans engagement

Concevoir des intentions Amazon Lex pour automatiser le Service Client sans dégrader l’expérience

La plupart des projets de Callbots échouent moins sur la technologie que sur la conception des intentions. Une Entreprise peut disposer du meilleur stack AWS et pourtant générer des taux d’échec élevés si les intentions ne correspondent pas aux formulations réelles des clients. La méthode la plus efficace consiste à partir des motifs d’appels du centre de contact : facturation, suivi de livraison, horaires, réinitialisation de mot de passe, changement d’adresse, prise de rendez-vous.

Un fil conducteur aide à rendre le sujet concret : imaginons “Alphea Services”, une ETI qui reçoit 25 000 appels par mois. Le top 5 des demandes représente 60% du volume. L’objectif n’est pas de tout automatiser, mais d’absorber ces motifs répétitifs. Lex permet de créer une intention “SuiviCommande”, une intention “ModifierAdresse”, une intention “RenvoiFacture”. La persuasion vient d’un fait opérationnel : chaque intention bien cadrée retire une charge mesurable aux équipes, et réduit mécaniquement la file d’attente.

Exemples d’énoncés : la matière première qui fait la différence au téléphone

Dans Lex, chaque intention s’alimente d’exemples. Le piège courant consiste à entrer des phrases “propres” et courtes, qui ne ressemblent pas au langage naturel. Or au téléphone, les gens ajoutent du contexte : “Bonjour, j’ai commandé la semaine dernière, je n’ai rien reçu, vous pouvez me dire où ça en est ?”. Le callbot doit reconnaître l’intention malgré l’habillage.

Une bonne pratique est de combiner des variations de syntaxe, de vocabulaire et d’ordre des mots. Il est aussi pertinent d’intégrer les formulations issues des transcriptions réelles (après anonymisation), car elles révèlent les hésitations, les mots parasites et les références implicites. Sur ce point, les fondamentaux du traitement du langage appliqués aux callbots sont détaillés dans un guide sur le NLP pour callbots, utile pour aligner équipes métiers et techniques.

Gestion des erreurs et escalade : la qualité perçue se joue dans les 20 premières secondes

Un callbot se juge vite. S’il se trompe au début, l’utilisateur perd confiance et demande un conseiller. Le design doit donc prévoir des stratégies de clarification : reformulation, question fermée, proposition de choix, ou bascule vers un humain avec un contexte transmis. Même sans entrer dans une approche “LLM everywhere”, il est possible de rendre l’expérience fluide par une orchestration intelligente.

Dans le cas d’Alphea Services, le callbot commence par une question simple : “Quel est le numéro de commande ?”. Si le client ne l’a pas, le bot propose une alternative : recherche par email + code postal. Cette logique n’est pas seulement conversationnelle, elle est métier : elle limite les abandons et augmente le taux de résolution. C’est exactement la frontière où Lex (NLU) doit être complété par Lambda (règles, vérifications), thème du prochain volet.

Conseil d’expert : avant d’ajouter des intentions, stabiliser d’abord 3 à 5 parcours “champions” avec un niveau de test élevé. Une intention mal conçue pollue les statistiques et rend les améliorations plus lentes.

Pour comprendre comment l’intention et la reconnaissance de demande se structurent, un approfondissement utile se trouve dans ce dossier sur l’intent recognition pour callbots, particulièrement pertinent quand les demandes se ressemblent (“modifier”, “annuler”, “résilier”).

AWS Lambda, IAM et API : industrialiser un Callbot Amazon Lex dans le SI d’Entreprise

Dans la pratique, Amazon Lex devient vraiment “entreprise-ready” quand il est relié au système d’information. Le moteur NLU identifie l’intention et collecte des slots, mais il faut ensuite vérifier, enrichir, décider et exécuter. C’est le rôle de AWS Lambda : une logique serverless capable de recevoir un événement JSON, d’appeler un CRM, de lire une base, de déclencher un workflow, puis de renvoyer une réponse structurée.

Cette séparation a un avantage net : le dialogue reste gouverné, tandis que le code métier évolue indépendamment. Elle a aussi une exigence : l’équipe doit maîtriser la gestion d’état, les cas limites, et la sécurité des accès. Un callbot n’est pas un simple chatbot web ; il manipule souvent des données plus sensibles, car l’appel téléphonique porte des demandes de compte, d’adresse, voire d’informations de paiement.

Comprendre la boucle JSON et la notion d’état conversationnel

Le principe d’échange est simple : Lex envoie à Lambda un payload contenant l’intention courante, les slots renseignés, et des attributs de session. Lambda renvoie un payload indiquant s’il faut fermer la conversation, poser une question, confirmer, ou exécuter. Même si l’implémentation varie, l’idée reste constante : l’orchestration vit dans la fonction.

Dans un scénario “RendezVous”, Lambda peut vérifier la disponibilité dans l’agenda, proposer deux créneaux, puis stocker la décision dans des attributs de session. La même structure permet d’intégrer des règles : blocage si le dossier est incomplet, demande d’authentification renforcée si le client veut changer une information critique, ou escalade vers un conseiller si le sentiment est négatif (avec une brique d’analyse dédiée).

Sécuriser l’accès : IAM, régions, signatures et tests d’API

Exposer Lex comme une API et la tester dans un outil de requêtage impose une discipline IAM. En entreprise, la question n’est pas “est-ce que ça marche”, mais “qui a le droit, dans quel périmètre, et comment tracer”. La configuration des clés et des signatures AWS, combinée au bon paramétrage de région, évite une grande partie des erreurs de déploiement. Cette étape est souvent sous-estimée, alors qu’elle conditionne les environnements (dev, préprod, prod) et les audits.

Pour des exemples de mise en œuvre et une vue plus “pas-à-pas” de l’intégration Lex/Lambda, la lecture de ce guide sur Lex et AWS Lambda aide à visualiser la chaîne technique avant de l’adapter aux contraintes SI.

Tableau comparatif : où se place Amazon Lex dans un projet callbot en 2026

Pour décider vite, il est utile de comparer Lex sur des critères opérationnels qui parlent à un directeur relation client comme à un DSI. Le tableau ci-dessous synthétise des points clés fréquemment observés en production.

| Critère | Amazon Lex (AWS) | Approche open-source on-prem (ex. Rasa) | Plateforme avec gestionnaire de dialogue intégré (ex. Watson-like) |

|---|---|---|---|

| Time-to-market | Rapide si l’écosystème AWS est déjà adopté | Variable, dépend des compétences internes et de l’hébergement | Rapide sur des parcours simples, parfois plus long sur l’intégration SI |

| Contrôle des données | Bon contrôle via IAM, chiffrement, VPC (selon architecture) | Très fort si tout est hébergé en interne | Dépend du cloud et des options de conformité |

| Gestion des entités contextuelles | Solide sur collecte guidée, plus limité sur “vocabulaire infini” | Souvent très puissant via pipelines NLP et règles | Variable selon l’éditeur et la maturité de NLU |

| Orchestration / machine à états | Généralement externalisée dans Lambda ou framework maison | Très flexible, mais demande rigueur de conception | Souvent intégré, bon pour des équipes non développeuses |

| Coût d’exploitation | Prévisible si le dimensionnement est suivi et les logs maîtrisés | Optimisable, mais charge de maintenance interne | Peut être élevé selon licences et montées en charge |

La logique qui s’impose : Lex est particulièrement convaincant quand l’organisation veut industrialiser sur AWS, tout en conservant une grande liberté côté code via Lambda. Le passage suivant montre comment enrichir l’expérience client avec les services vocaux et le centre de contact.

Découvrir AirAgent · Démo personnalisée offerte

Reconnaissance Vocale, Polly, Connect : construire un callbot de bout en bout avec AWS

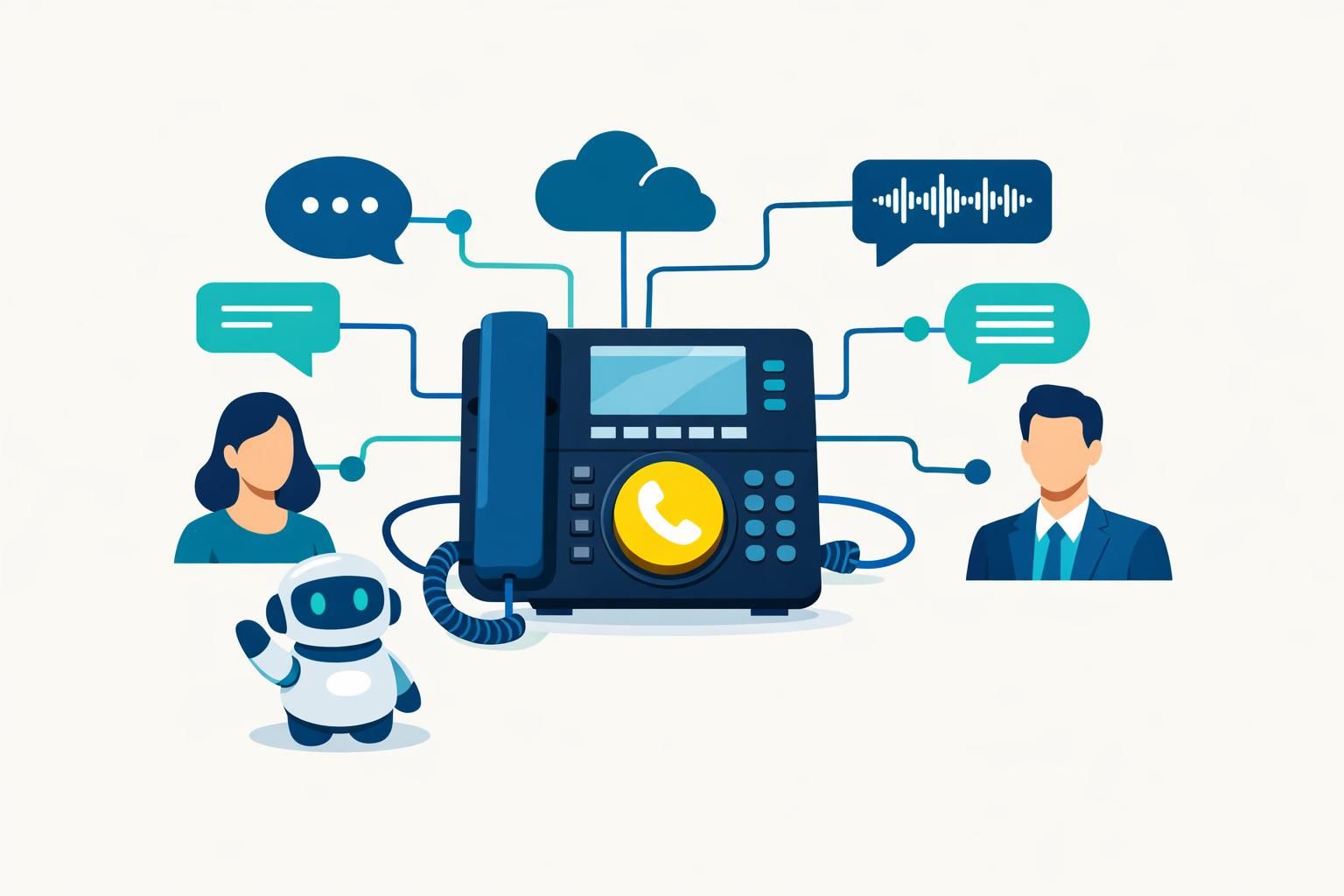

Un callbot n’est pas un chatbot “avec une voix ajoutée”. La Reconnaissance Vocale amène ses propres contraintes : bruit ambiant, accents, hésitations, chevauchement de parole, et attentes fortes en rapidité. C’est ici que l’écosystème AWS devient intéressant : Amazon Lex pour la compréhension, text-to-speech via une brique de synthèse, et l’ancrage centre de contact via une solution de téléphonie cloud.

Dans une Entreprise, la chaîne cible ressemble souvent à ceci : l’appel arrive sur le centre de contact, le callbot qualifie la demande, puis soit résout (self-service), soit transfère à un agent avec un contexte déjà collecté. Ce “contexte transmis” est l’un des leviers les plus rentables : même quand l’appel finit chez un conseiller, le temps de traitement baisse parce que l’identification et la qualification ont été faites en amont.

Voix naturelle : la qualité perçue dépend du TTS autant que du NLU

La voix est l’interface. Une synthèse trop robotique réduit la confiance, surtout sur des sujets sensibles (banque, assurance, santé). Pour cadrer les choix, il est utile d’explorer les critères d’un text-to-speech réaliste, notamment l’intonation, les pauses, et la prononciation des noms propres. Une ressource pratique sur ce sujet est ce guide sur le TTS naturel pour callbots, qui aide à formaliser un cahier des charges “voix” au-delà du simple paramétrage.

Un exemple simple : pour annoncer un numéro de dossier, le callbot doit épeler correctement, marquer des pauses, et proposer d’envoyer l’information par SMS si la mémorisation est difficile. Ce détail, très humain, limite les rappels et améliore la satisfaction.

De l’appel à l’action : scénarios concrets d’automatisation en service client

Reprenons Alphea Services. Le callbot gère d’abord le suivi de commande. S’il détecte un retard, il propose une compensation standard (bon d’achat) selon des règles métier, puis envoie une confirmation par email. Deuxième scénario : une demande de renvoi de facture. Le bot vérifie l’identité via un code, récupère la facture, et la transmet. Dans ces cas, Automatisation ne signifie pas “déshumanisation” : cela signifie “réponse immédiate sur les demandes répétitives”.

Pour organiser correctement la brique vocale côté compréhension, il est pertinent de maîtriser les notions de speech-to-text et de captation. Un approfondissement utile se trouve dans ce dossier sur le speech-to-text pour callbots, notamment pour comprendre les impacts sur les taux de reconnaissance et la gestion des silences.

Liste des intégrations AWS typiques pour un callbot d’entreprise

Un callbot vraiment utile se connecte rarement à un seul système. Les intégrations les plus fréquentes, observées en déploiement, combinent plusieurs briques :

- AWS Lambda pour orchestrer la logique et intégrer le SI sans serveur.

- Amazon S3 pour stocker des assets (prompts, journaux, exports) et des données non structurées.

- DynamoDB ou une base métier pour conserver des états, des préférences et des métadonnées de session.

- Amazon Connect (ou une téléphonie équivalente) pour router, transférer et mesurer l’activité du centre d’appels.

- Une couche CRM pour identifier le client, tracer le contact et déclencher des actions.

Ce socle prépare naturellement la question décisive pour les décideurs : comment cadrer coûts, sécurité, conformité et performance sans transformer le projet en chantier interminable ?

Gouvernance, coûts et conformité : réussir Amazon Lex pour des Callbots en Entreprise

Déployer Amazon Lex dans une Entreprise ne se limite pas à publier un bot. La réussite se mesure à la stabilité en production, au respect des politiques internes, et à la capacité d’améliorer le système sans rupture. Trois axes dominent : gouvernance (qui change quoi), conformité (données et consentement), et pilotage économique (coût par appel automatisé, coût des erreurs, coût du logging).

Sur la conformité, le défi est constant : les solutions NLU cloud posent la question des informations personnelles. La réponse n’est pas un slogan, mais une architecture : minimisation des données, masquage en logs, chiffrement, segmentation des droits, et conservation limitée. En parallèle, des mécanismes de consentement et d’information utilisateur renforcent la confiance, surtout quand le callbot intervient sur des opérations sensibles.

Mesurer ce qui compte : du taux d’automatisation à la satisfaction

Un callbot doit être piloté comme un canal. Les métriques utiles ne se limitent pas au nombre d’appels gérés : il faut regarder la résolution au premier contact, la durée moyenne, le taux de transfert vers un humain, et les motifs d’échec (intentions confondues, slots manquants, erreurs d’authentification). Ces indicateurs deviennent des “tickets” d’amélioration priorisés.

Une pratique efficace consiste à organiser des revues hebdomadaires entre relation client et IT. Quand une intention échoue souvent, l’équipe métier apporte les formulations réelles et l’équipe technique ajuste les exemples, les prompts et la logique Lambda. C’est une boucle d’amélioration continue, comparable à l’optimisation d’un script de vente, mais pilotée par la donnée.

Encadrement des données : éviter les fuites par les logs et les traces

Les traces sont indispensables pour déboguer, mais elles peuvent aussi devenir un risque si elles capturent des informations sensibles. Une politique stricte de masquage (numéros, emails, identifiants) s’impose. L’idée n’est pas de supprimer l’observabilité, mais de la rendre compatible avec les exigences internes et réglementaires. Sur ce point, beaucoup d’organisations gagnent à formaliser une “charte conversationnelle” : quelles informations le bot a le droit de demander, à quel moment, et sous quelle forme.

Ressources pratiques pour accélérer sans sacrifier la rigueur

Quand l’équipe doit cadrer le développement, la documentation officielle reste la référence pour structurer correctement les bots Lex V2. Une lecture utile pour consolider les pratiques est le guide AWS sur la construction de bots Lex, à utiliser comme socle de conformité interne (naming, versions, tests, déploiements).

Enfin, l’écosystème propose de nombreux retours d’expérience sur la mise en place Lex + Lambda. Un exemple accessible est cet article sur la création d’un chatbot avec Lex et Lambda, utile pour comparer les choix d’implémentation et se projeter dans un scénario entreprise.

À retenir : la technologie accélère, mais la gouvernance sécurise. Un callbot réussi est un produit vivant, piloté par des métriques, pas un projet figé livré une fois.

Demander une démo AirAgent · Réponse sous 24h

Amazon Lex suffit-il à lui seul pour créer des callbots en entreprise ?

Amazon Lex couvre la compréhension (intentions, slots) et une partie des prompts, mais un callbot d’entreprise nécessite généralement une logique externe pour la gestion d’état, la validation et l’intégration SI. Cette orchestration est souvent réalisée via AWS Lambda afin d’implémenter règles métier, contrôles de sécurité et appels aux applications internes.

Quelle différence entre intentions, entités et slots dans Amazon Lex ?

Les intentions représentent le but de l’utilisateur (le “verbe” : suivre une commande, modifier une adresse). Les informations à collecter (le “nom” : numéro de commande, date, montant) sont modélisées dans Lex sous forme de slots. Le callbot collecte ces slots via des questions et peut imposer des priorités, des confirmations et des relances pour fiabiliser le parcours.

Comment améliorer la reconnaissance vocale et éviter les incompréhensions au téléphone ?

La qualité se joue sur plusieurs couches : des prompts courts et explicites, des relances bien conçues, une gestion des silences et des corrections, et une collecte d’exemples d’énoncés réalistes. Il est aussi crucial d’anticiper les contextes bruités et les formulations longues, puis de mesurer les motifs d’échec pour itérer régulièrement.

Quelles bonnes pratiques sécurité pour un callbot AWS manipulant des données clients ?

Les pratiques clés incluent le principe du moindre privilège via IAM, le chiffrement des données, la minimisation des informations demandées, le masquage des données sensibles dans les logs, et une politique de conservation limitée. En complément, une escalade vers un agent avec transfert de contexte évite de forcer l’utilisateur à répéter des informations sensibles.