Sommaire

- 1 Traitement du Langage Naturel : pourquoi il change la donne pour les callbots

- 2 Du son à l’intention : comment le NLP alimente le dialogue homme-machine des callbots

- 3 Génération de réponse, synthèse vocale et intégrations : le callbot moderne en production

- 4 Mesure, qualité et risques : piloter l’automatisation des services sans perdre la confiance

- 5 Cas d’usage 2026 : où le traitement du langage naturel rend les callbots rentables

- 5.1 À retenir : le bon cas d’usage ressemble à une conversation courte et utile

- 5.2 Le Traitement du Langage Naturel suffit-il pour créer un callbot performant ?

- 5.3 Quelle différence entre un callbot à règles et un callbot basé sur l’apprentissage automatique ?

- 5.4 Comment réduire les erreurs liées à la reconnaissance vocale ?

- 5.5 Quels KPI suivre pour piloter l’automatisation des services par callbot ?

Les callbots ne sont plus de simples « boîtes vocales » qui routent des appels vers le bon service. En 2026, ils se comportent comme de véritables agents de première ligne, capables de comprendre une demande formulée spontanément, de clarifier une ambiguïté, puis d’exécuter une action concrète. Ce saut qualitatif repose sur un socle souvent mal compris : le Traitement du Langage Naturel. Derrière la promesse d’une expérience fluide se cache une mécanique exigeante, où la Reconnaissance Vocale doit résister au bruit, aux accents et aux hésitations, tandis que la Compréhension du Langage doit saisir l’intention réelle, même quand l’utilisateur « tourne autour du pot ». La différence se joue dans les détails : une négation oubliée, une date mal interprétée, une entité produit confondue, et c’est toute la confiance qui vacille.

Dans les centres de contact, le Dialogue Homme-Machine devient alors une discipline à part entière : penser la conversation comme un parcours, mais aussi comme un espace de liberté. Les décideurs y trouvent une opportunité pragmatique : accélérer l’Automatisation des Services sur les motifs répétitifs, sans dégrader l’image de marque ni saturer les équipes. À condition d’adresser le cœur technique du sujet : modèles linguistiques, Analyse Syntaxique, détection d’intentions, gestion des erreurs, et orchestration voix (STT) + Synthèse Vocale. Le gain n’est pas seulement financier ; il est aussi opérationnel, avec une qualité de service plus régulière, y compris aux heures de pointe.

- Le Traitement du Langage Naturel est le moteur qui transforme une phrase en intention exploitable par un callbot.

- Un callbot performant coordonne Reconnaissance Vocale, compréhension, et exécution métier (CRM, back-office, prise de rendez-vous).

- Les étapes clés incluent tokenisation, normalisation, Analyse Syntaxique, extraction d’entités et génération de réponse.

- L’Apprentissage Automatique et les modèles génératifs améliorent la robustesse, mais exigent des garde-fous (biais, conformité, escalade humain).

- La qualité dépend autant des données (exemples réels, variations) que du design conversationnel (clarification, confirmations).

- Une mesure rigoureuse (taux de résolution, transferts, compréhension au premier tour) conditionne le ROI.

Traitement du Langage Naturel : pourquoi il change la donne pour les callbots

Le Traitement du Langage Naturel peut être compris comme l’ensemble des méthodes permettant à un système de manipuler le langage humain, qu’il soit écrit ou parlé. Dans l’univers des Callbots, l’enjeu est immédiat : convertir une conversation en actions fiables, sans imposer à l’appelant un langage artificiel. Quand une cliente dit « je voudrais décaler ma livraison, c’est prévu demain mais je serai pas là », le système doit comprendre qu’il s’agit d’une modification de date, identifier « livraison » comme l’objet, « demain » comme contrainte temporelle, et détecter la nuance de négation. Ce niveau de finesse est le cœur de la Compréhension du Langage, bien au-delà d’un simple repérage de mots-clés.

Pour un directeur de la relation client, la promesse est concrète : réduire les temps d’attente, augmenter le taux de réponse, et absorber les pics d’appels (facturation, suivi de commande, horaires, prise de rendez-vous). Mais le vrai bénéfice se révèle dans la stabilité. Un SVI classique se fatigue vite : trop de menus, trop de « dites 1, dites 2 ». Un callbot moderne, lui, gère la conversation en langage naturel et reformule si nécessaire. Cette capacité s’appuie sur l’Intelligence Artificielle et sur l’Apprentissage Automatique, qui permettent de reconnaître des formulations très variées sans reconfigurer des centaines de règles.

Un fil conducteur aide à matérialiser cette transformation. Prenons une PME fictive, « Atelier Nova », qui reçoit 1 200 appels par semaine. Avant modernisation, 60% concernent des demandes répétitives : statut de commande, changement d’adresse, disponibilité produit, annulation. Après déploiement d’un callbot, l’objectif n’est pas de « remplacer » les agents, mais d’absorber ce volume simple pour libérer du temps sur les cas sensibles. La direction constate souvent un effet collatéral : la hausse de satisfaction interne. Les conseillers passent moins de temps à répéter les mêmes informations et davantage à résoudre des situations à valeur ajoutée.

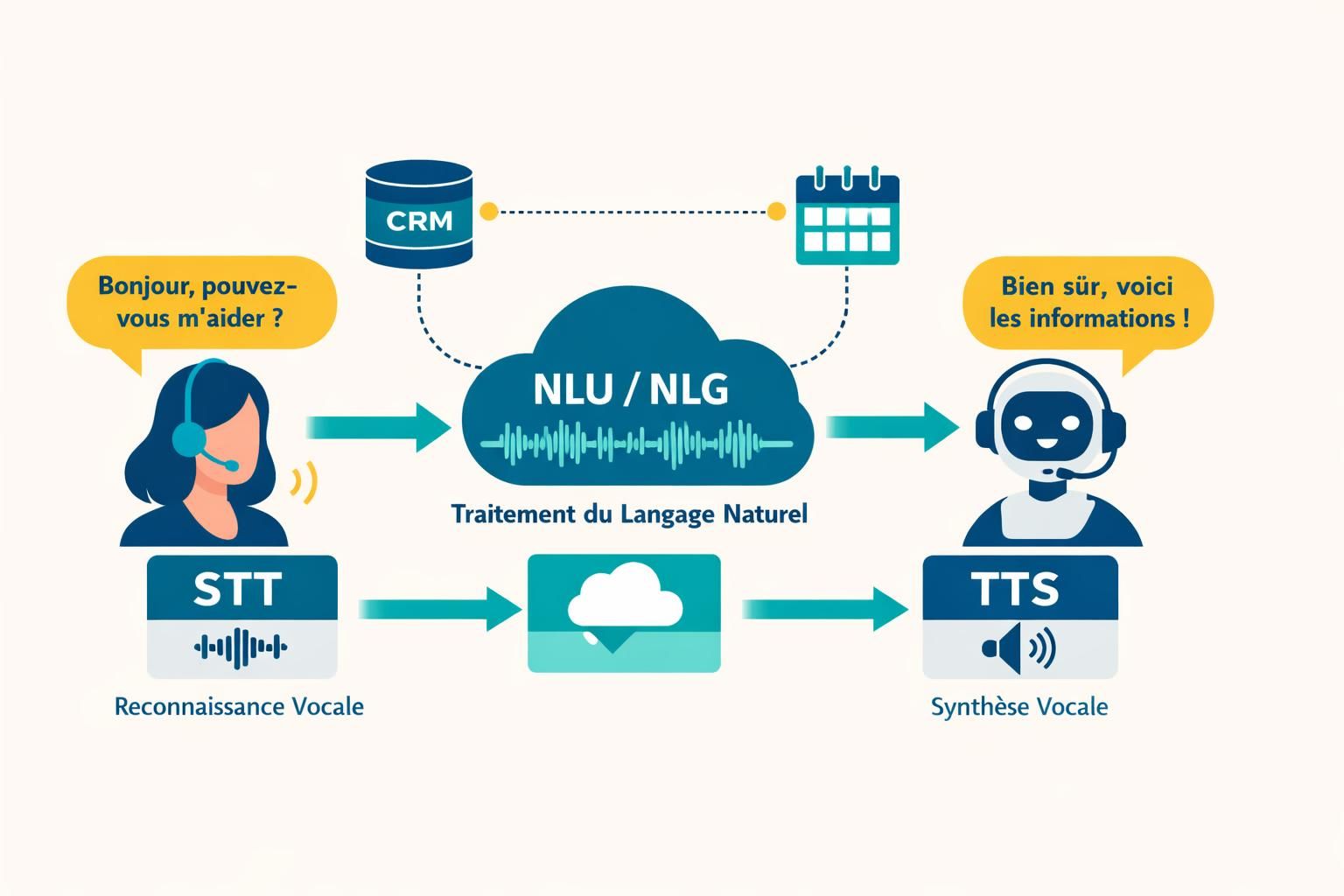

Pour cadrer la technologie sans la noyer dans le jargon, il est utile de rappeler que le callbot combine trois briques : Reconnaissance Vocale (voix vers texte), Traitement du Langage Naturel (interprétation), puis orchestration et réponse (texte vers voix via Synthèse Vocale). La partie NLP se décline généralement en NLU (compréhension) et NLG (génération), avec une logique de dialogue qui choisit la bonne question de clarification. Cette articulation est décrite dans de nombreux décryptages, notamment via la définition du NLP selon IBM et des ressources pratiques sur le fonctionnement détaillé du traitement du langage naturel.

Mais comment savoir si l’approche est adaptée à un standard téléphonique précis ? Une règle simple s’impose : plus le langage client est spontané (accents, hésitations, phrases longues), plus la qualité NLP devient déterminante. La section suivante plonge dans la chaîne technique, de la voix brute à l’intention structurée, là où se gagne — ou se perd — l’adhésion des appelants.

Tester AirAgent gratuitement · Sans engagement

Du son à l’intention : comment le NLP alimente le dialogue homme-machine des callbots

Dans un callbot, tout commence par la Reconnaissance Vocale. Le signal audio est transformé en texte via un moteur de STT (*speech-to-text*). À ce stade, la performance dépend de conditions très opérationnelles : bruit de fond (voiture, open space), qualité du réseau, micro du téléphone, et même vitesse d’élocution. Un directeur technique y voit un point critique : si le STT se trompe, le Traitement du Langage Naturel analysera un texte déjà dégradé. C’est pourquoi les architectures matures traitent les incertitudes (scores de confiance) et prévoient des stratégies de confirmation. Pour approfondir ce maillon, un angle utile consiste à parcourir les bases du speech-to-text pour callbots et les enjeux pratiques de la reconnaissance vocale en centre de contact.

Une fois le texte obtenu, le NLP lance une série d’étapes, souvent invisibles mais décisives. La tokenisation découpe la phrase en unités exploitables. Selon les modèles, ces unités peuvent être des mots, des sous-mots ou des fragments, ce qui permet de mieux gérer les noms de marque, les fautes et les néologismes. Ensuite vient la normalisation : gestion de la casse, suppression de caractères parasites, correction légère, et parfois la suppression de mots peu informatifs. Toutefois, retirer des mots « vides » à l’aveugle est dangereux : dans une phrase comme « je ne veux pas résilier », le « pas » est le pivot du sens. Les meilleurs systèmes maintiennent des règles contextuelles et laissent au modèle sémantique le soin de hiérarchiser l’information.

Analyse syntaxique et extraction : quand une phrase devient une action

L’Analyse Syntaxique vise à repérer la structure : verbes, objets, compléments, dépendances. Cette lecture structurelle aide à désambiguïser. Dans « je peux changer mon rendez-vous de mardi à jeudi », la relation entre « changer » et « rendez-vous » est plus importante que la présence du mot « jeudi ». Le callbot en déduit l’action « replanifier », et non « créer ». Cette précision est un facteur direct de réduction des transferts vers les équipes humaines.

Vient ensuite l’extraction d’entités. Les entités sont les morceaux de réalité que l’entreprise sait manipuler : numéro de commande, date, produit, agence, identifiant client. Pour « Atelier Nova », une entité « commande » peut prendre la forme « AB-39421 » ou « ma commande de la semaine dernière ». Le modèle doit donc reconnaître les formats, mais aussi les références relatives. Cette couche d’interprétation s’améliore grâce à l’Apprentissage Automatique, en enrichissant le jeu d’exemples avec des formulations réelles issues des conversations.

Compréhension du langage et gestion des clarifications

La Compréhension du Langage ne consiste pas seulement à classifier une intention ; elle doit aussi gérer l’incomplétude. Si l’appelant dit « je veux payer », la question suivante est presque toujours « payer quoi, et comment ? ». C’est ici que le Dialogue Homme-Machine devient un art d’orchestration : poser une question courte, contextualisée, sans transformer l’appel en interrogatoire. Un callbot performant alterne entre questions ouvertes (« quel est le numéro de commande ? ») et confirmations (« c’est bien pour décaler la livraison à jeudi ? »), selon la confiance du modèle.

Une vidéo technique aide souvent à visualiser cette chaîne de valeur, notamment sur la différence entre NLU et gestion de dialogue dans des assistants vocaux.

Ce passage du « comprendre » au « faire » prépare naturellement le sujet suivant : une fois l’intention captée, comment industrialiser la génération de réponses et l’intégration aux outils métiers, sans perdre le contrôle de la conformité et de l’expérience ?

Génération de réponse, synthèse vocale et intégrations : le callbot moderne en production

Une fois l’intention déterminée, le callbot doit répondre. Cette étape combine NLG (génération de texte), puis Synthèse Vocale (*text-to-speech*) pour restituer une voix naturelle. En pratique, la qualité perçue est aussi importante que la qualité algorithmique. Une réponse correcte mais récitée avec une prosodie robotique réduit la confiance. À l’inverse, une voix fluide et bien ponctuée donne l’impression d’un service « pensé pour le téléphone ». Les DSI le constatent rapidement : le canal voix tolère moins l’approximation que le chat, car l’utilisateur ne peut pas relire. Pour une vision orientée production, un guide sur le text-to-speech naturel pour callbots clarifie les paramètres clés (rythme, pauses, prononciation des sigles, personnalisation).

Sur le plan métier, la réponse n’est pas qu’une phrase : c’est souvent une action. « Payer une facture », « envoyer un duplicata », « réserver un créneau », « bloquer une carte », « reprogrammer une livraison ». Un callbot crédible doit donc se connecter au CRM, à l’ERP, au système de ticketing, ou à un agenda. Cette orchestration passe généralement par des API, avec une logique de sécurité : authentification, contrôle des droits, traçabilité. Pour « Atelier Nova », la bascule vers un callbot a réellement décollé le jour où le bot a pu lire le statut de commande en temps réel et non via une base de connaissances statique. Le client entend alors une information à jour, ce qui réduit les rappels et les escalades.

Tableau comparatif : règles, machine learning et modèles génératifs

Pour décider d’une approche, il est utile de distinguer trois familles qui coexistent souvent dans un même projet : règles, modèles classiques de machine learning, et modèles génératifs. Le tableau ci-dessous sert de repère opérationnel, notamment pour arbitrer entre rapidité de mise en œuvre et robustesse linguistique.

| Approche | Forces | Limites | Usage typique en callbot |

|---|---|---|---|

| Rule-based (règles + mots-clés) | Contrôle total, prévisible, simple à auditer | Fragile aux formulations variées, maintenance lourde | Horaires, routage simple, FAQ très cadrées |

| Apprentissage Automatique (classification intentions + entités) | Bon compromis robustesse/contrôle, s’améliore avec les données | Besoin d’exemples de qualité, dérive possible sans monitoring | Suivi de commande, gestion SAV, prises d’informations structurées |

| Modèles génératifs (*LLM*) | Très bonne couverture linguistique, gestion du contexte, reformulation | Risque d’hallucination sans garde-fous, gouvernance plus complexe | Guidage conversationnel, compréhension fine, réponses rédigées avec prudence |

Encadré « À retenir » : ce qui rend une réponse vocale réellement utile

À retenir : une réponse callbot n’est « bonne » que si elle est compréhensible à l’oral, actionnable (connectée au système métier) et vérifiable (capable d’expliquer ou de confirmer). Quand un doute existe, la meilleure stratégie n’est pas d’improviser, mais de demander une précision ou de transférer au bon niveau.

Une seconde vidéo centrée sur l’industrialisation (monitoring, intégration, qualité) aide à projeter le sujet en production, au-delà du prototype.

Ce socle « production » ouvre un point souvent décisif pour les décideurs : comment mesurer la performance, réduire les risques (biais, conformité), et concevoir des parcours qui n’énervent pas les appelants. C’est l’objet de la prochaine partie.

Mesure, qualité et risques : piloter l’automatisation des services sans perdre la confiance

Déployer des Callbots sans pilotage, c’est s’exposer à un paradoxe : plus le volume traité augmente, plus les erreurs deviennent visibles. En centre de contact, une poignée de conversations ratées peut suffire à alimenter une mauvaise réputation. Le pilotage doit donc reposer sur des métriques simples, reliées à la réalité métier : taux de compréhension au premier tour, taux de résolution sans agent, taux de transfert, et satisfaction post-appel quand elle est mesurable. Pour « Atelier Nova », une mesure particulièrement utile a été le « taux de clarification » : combien de fois le callbot doit-il reformuler ou reposer une question ? Trop élevé, cela signale un problème d’entités ou de script, même si la conversation aboutit.

La conception conversationnelle pèse autant que les modèles. Une logique efficace évite les tunnels et privilégie les micro-confirmations. Exemple : après avoir capté une date, le callbot peut répéter « d’accord, pour jeudi 14 au matin » afin d’éviter un malentendu. Cette approche réduit les erreurs coûteuses (rendez-vous ratés, livraisons reprogrammées à tort) et améliore l’acceptation. Pour des recommandations très pratiques côté wording et scénarios, des scripts de callbot efficaces donnent un cadre concret pour éviter les formulations qui crispent.

Conseil d’expert : traiter l’erreur comme un moment de service

Conseil d’expert : lorsqu’une incompréhension survient, le callbot doit l’assumer avec clarté et proposer une alternative immédiate. Une phrase du type « Pour être sûr, une précision : souhaitez-vous modifier la date ou l’adresse de livraison ? » fonctionne mieux qu’un « je n’ai pas compris ». Cette micro-stratégie améliore le Dialogue Homme-Machine et diminue les abandons, car l’utilisateur voit un chemin de sortie au lieu d’un mur.

Les risques ne se limitent pas à l’expérience. Les biais peuvent apparaître si les données d’entraînement surreprésentent certains profils d’appelants (accents, régions, jargons métiers). Le résultat est une inégalité de traitement : certains utilisateurs sont compris, d’autres non. En 2026, les directions conformité et juridique demandent souvent des garanties : traçabilité, conservation des enregistrements selon politique interne, anonymisation, et gouvernance des modèles. Une ressource orientée relation client illustre bien les enjeux d’équilibre entre automatisation et satisfaction via un éclairage sur chatbots, callbots et traitement du langage.

Enfin, le transfert vers un humain doit être conçu comme une continuité et non comme un échec. Quand un client exprime une urgence, une émotion forte, ou une situation atypique, l’escalade devient un signe de maturité. Le callbot doit transmettre un contexte structuré : intention détectée, entités extraites, étapes déjà réalisées. Les agents gagnent alors un temps précieux, et l’appelant n’a pas à « tout répéter ». À ce stade, la technologie rejoint la stratégie : la qualité d’Automatisation des Services se mesure à la façon dont elle protège les cas sensibles.

Une fois le pilotage en place, la question suivante devient presque évidente : par quels cas d’usage démarrer pour obtenir un ROI rapide, sans fragiliser l’organisation ?

Cas d’usage 2026 : où le traitement du langage naturel rend les callbots rentables

Les projets qui réussissent démarrent rarement par « tout automatiser ». Ils ciblent des cas d’usage où le Traitement du Langage Naturel apporte un avantage immédiat : compréhension de demandes répétitives, collecte d’informations structurées, et exécution d’actions simples. Dans la restauration, par exemple, la prise de réservation téléphonique est un terrain idéal. Les appels suivent une logique stable (date, heure, nombre de personnes, nom, contraintes), mais la formulation varie énormément (« ce soir vers 20h », « pour deux, mais peut-être trois », « à l’intérieur si possible »). Un callbot bien entraîné extrait les entités, confirme, puis écrit dans l’agenda. Pour se projeter, un exemple de callbot pour réservations permet de visualiser les points d’attention (annulations, retards, doublons).

Dans le retail et l’e-commerce, la pression est souvent sur le suivi de commande et le SAV. Un callbot peut prendre en charge « où en est mon colis ? », « je veux changer l’adresse », « je veux retourner ». Ici, la valeur dépend de l’intégration SI : si le bot peut consulter le transporteur et le CRM, il devient crédible. Sinon, il se contente de généralités et génère de la frustration. C’est précisément l’endroit où Intelligence Artificielle et intégration se rejoignent : comprendre ne suffit pas, il faut agir.

À retenir : le bon cas d’usage ressemble à une conversation courte et utile

À retenir : un cas d’usage rentable combine trois critères : un volume d’appels significatif, une action clairement exécutable (ou un routage intelligent), et des données disponibles (CRM, commandes, rendez-vous). Quand ces trois éléments sont réunis, le callbot devient un accélérateur plutôt qu’un gadget.

Les secteurs réglementés (banque, assurance, santé) ajoutent une contrainte : l’authentification et la conformité. Pourtant, ce sont aussi des environnements où l’Automatisation des Services a un impact fort, car les demandes récurrentes sont nombreuses. Le bon pattern consiste à automatiser la pré-qualification : identifier le motif, collecter les informations, puis orienter vers un conseiller avec un dossier déjà rempli. Le client y gagne en fluidité ; l’entreprise réduit la durée moyenne de traitement.

Pour les dirigeants de PME, une approche pragmatique consiste à démarrer par un « standard intelligent » : qualification des appels, réponse aux questions fréquentes, prise de message structurée, puis transfert. Le projet devient alors un chantier mesuré, avec un périmètre maîtrisé et un apprentissage progressif. Pour explorer les options du marché et se faire une idée des modèles, un panorama de callbots en 2026 aide à comparer les approches, sans perdre de vue le critère central : la qualité de compréhension.

Ce tour d’horizon amène naturellement à la dernière dimension, souvent décisive : comment transformer ce socle technique en déploiement rapide, pilotable, et accessible, sans immobiliser une équipe pendant des mois.

Découvrir AirAgent · Démo personnalisée offerte

Le Traitement du Langage Naturel suffit-il pour créer un callbot performant ?

Non. Un callbot fiable combine Reconnaissance Vocale (STT), Traitement du Langage Naturel (NLU/NLG), gestion de dialogue, intégrations métier (CRM, ERP, agenda) et Synthèse Vocale. Le NLP est le cœur de la compréhension, mais la performance dépend aussi du design conversationnel, des données d’entraînement et du pilotage en production.

Quelle différence entre un callbot à règles et un callbot basé sur l’apprentissage automatique ?

Un callbot à règles s’appuie sur des scénarios et mots-clés prédéfinis : il est simple et contrôlable, mais fragile dès que l’utilisateur s’exprime différemment. Un callbot fondé sur l’Apprentissage Automatique apprend à reconnaître des intentions et entités à partir d’exemples, ce qui améliore la Compréhension du Langage et la robustesse face aux variations, à condition de monitorer et d’enrichir les données.

Comment réduire les erreurs liées à la reconnaissance vocale ?

La stratégie la plus efficace combine un STT adapté au téléphone, la prise en compte des scores de confiance, des confirmations courtes quand l’incertitude est élevée, et des formulations guidées (exemples de réponses attendues). L’environnement (bruit, réseau) doit aussi être considéré, car il influence directement la qualité du texte transmis au NLP.

Quels KPI suivre pour piloter l’automatisation des services par callbot ?

Les KPI les plus actionnables sont le taux de résolution sans agent, le taux de transfert vers un humain, le taux de compréhension au premier tour, le taux d’abandon et le nombre moyen de clarifications. Il est utile d’ajouter un suivi qualitatif (écoutes ciblées) pour repérer les situations où l’utilisateur se sent bloqué, même si la conversation aboutit.