Sommaire

- 1 Analyse des sentiments et intelligence vocale : ce que la voix “dit” vraiment en centre de contact

- 2 Détection des émotions : comment l’analyse vocale et le traitement du langage naturel se complètent

- 3 Reconnaissance des sentiments : critères de choix, comparatif et pièges à éviter en 2026

- 4 Détection des émotions en production : intégration callbot, gouvernance et ROI mesurable

- 5 Au-delà de l’analyse : voix de synthèse émotionnelle et expérience client réellement cohérente

- 5.1 Quand la synthèse vocale émotionnelle améliore réellement le parcours

- 5.2 Mettre des limites : éviter l’effet “trop empathique”

- 5.3 Raccorder émotion et utilité : le test qui ne trompe pas

- 5.4 Quelle différence entre analyse des sentiments et détection des émotions sur la voix ?

- 5.5 La reconnaissance des sentiments fonctionne-t-elle en temps réel sur des appels bruités ?

- 5.6 Quels KPI suivre pour mesurer le ROI de l’intelligence vocale émotionnelle ?

- 5.7 Comment éviter les biais dans l’identification des émotions ?

En bref

- L’analyse des sentiments appliquée à la voix combine analyse vocale, traitement du langage naturel et apprentissage automatique pour qualifier l’état émotionnel perçu.

- La détection des émotions ne se limite pas aux mots : rythme, pauses, intensité et analyse des tonalités pèsent autant que le verbatim.

- En centre de contact, la reconnaissance des sentiments sert surtout à prioriser, aider au routage, détecter l’escalade et améliorer la qualité, pas à “psychanalyser”.

- La performance dépend du contexte (secteur, langue, bruit, typologie d’appels) et d’une calibration métier, plus que d’une promesse “prête à l’emploi”.

- Les enjeux 2026 : conformité, transparence, réduction des biais, et intégration fluide avec CRM, enregistrements et outils de pilotage.

Sur une ligne téléphonique, la voix transporte plus que des mots : elle révèle des indices de fatigue, d’agacement, d’enthousiasme ou d’inquiétude qui orientent la qualité de la réponse. C’est précisément là que l’analyse des sentiments prend une nouvelle dimension : au lieu de se limiter à l’écrit, elle s’appuie sur l’intelligence vocale pour interpréter les signaux acoustiques et contextuels d’une conversation. Pour un directeur de la relation client, l’enjeu est concret : réduire l’escalade, mieux prioriser les appels, aider les conseillers et rendre les callbots plus “humains” sans tomber dans la surpromesse.

La détection des émotions par la voix progresse vite en 2026, portée par de meilleurs modèles, des corpus plus riches et des approches multimodales qui croisent audio et texte. Mais une réalité demeure : l’identification des émotions n’est utile que si elle s’insère dans un processus opérationnel clair, avec des seuils, des actions et une gouvernance. Une émotion détectée sans action n’est qu’un score de plus dans un tableau. À l’inverse, une mesure simple, stable et bien intégrée peut devenir un levier direct de satisfaction et de productivité.

Analyse des sentiments et intelligence vocale : ce que la voix “dit” vraiment en centre de contact

L’analyse des sentiments sur la voix vise à estimer un état affectif probable à partir du signal audio et du contenu de l’échange. Contrairement à une approche uniquement textuelle, l’analyse vocale exploite des indices comme la prosodie (intonation, accentuation), le débit, la dynamique d’énergie, ou encore la distribution des pauses. Une phrase neutre comme “d’accord” peut signifier l’acceptation, l’ironie ou la résignation selon l’intonation : c’est là que l’analyse des tonalités devient décisive.

Pour rester utile en entreprise, la reconnaissance des sentiments n’a pas besoin de “lire l’âme” d’un appelant. Elle doit surtout répondre à des questions simples : la situation s’envenime-t-elle ? le client est-il rassuré après l’explication ? le callbot doit-il transférer à un humain ? Cette logique “actionnable” évite l’écueil de la sophistication inutile et accélère le ROI.

Des signaux acoustiques aux catégories émotionnelles : une traduction contrôlée

Dans la pratique, les modèles classent ou scorent des catégories (colère, frustration, joie, neutralité, anxiété) ou des dimensions (valence positive/négative, activation). Les signaux audio sont transformés en caractéristiques : variations de fréquence fondamentale, énergie, spectre, rythmicité. Ensuite, l’apprentissage automatique apprend des correspondances statistiques entre ces caractéristiques et des labels émotionnels fournis par des annotateurs.

Cette étape d’annotation est souvent sous-estimée. Deux personnes peuvent interpréter différemment la même séquence vocale, surtout selon le contexte (réclamation, incident technique, annonce médicale). Une approche robuste impose des consignes d’annotation, des contrôles de cohérence, et parfois une calibration par métier. À ce titre, des approches issues de travaux académiques sur la reconnaissance automatique des émotions ont montré l’importance du protocole et du corpus, à l’image de ressources telles que ces travaux de recherche sur l’analyse acoustique et la reconnaissance des émotions.

Étude de cas fil conducteur : la PME “Alphea Énergie” et ses pics de tension

Une PME fictive, Alphea Énergie, subit des pics d’appels lors des régularisations. Les conseillers décrivent une fatigue liée aux clients “à cran”, tandis que le DSI veut réduire les transferts inutiles. En déployant une détection des émotions simple (trois états : apaisé, tendu, critique), l’équipe met en place un déclencheur : si l’état “critique” se maintient au-delà de 12 secondes, le callbot stoppe les scripts longs, reformule et propose un passage prioritaire à un conseiller spécialisé.

Résultat attendu : moins de dialogues “en boucle”, un temps moyen de traitement stabilisé, et surtout une baisse des escalades qui coûtent cher. L’insight clé est limpide : l’émotion devient un signal de pilotage, pas une curiosité analytique.

Pour passer du concept à un dispositif industrialisable, le sujet suivant s’impose : comment ces signaux sont-ils extraits, et comment le texte (transcrit) complète l’audio pour éviter les contresens ?

Tester AirAgent gratuitement · Sans engagement

Détection des émotions : comment l’analyse vocale et le traitement du langage naturel se complètent

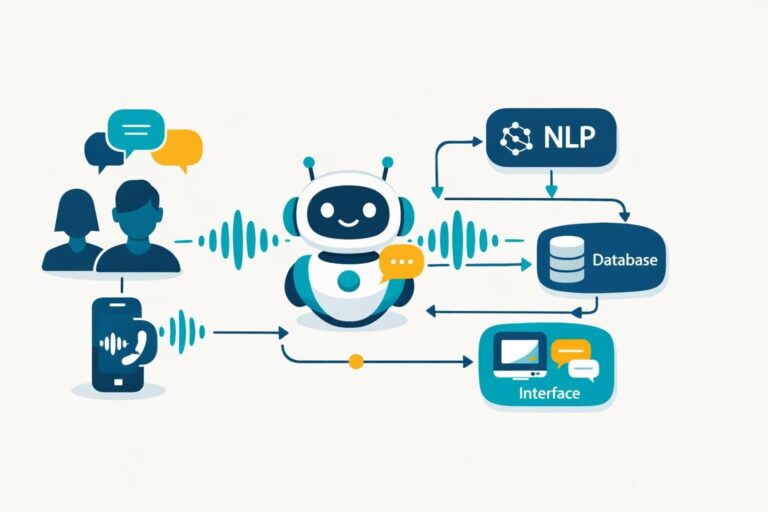

Un système de détection des émotions en environnement téléphonique a rarement le luxe d’un audio parfait. Il doit composer avec le bruit, les codecs, les variations de micro et les interruptions. C’est pourquoi les meilleures architectures combinent analyse vocale et traitement du langage naturel sur la transcription. L’audio capte la manière de dire ; le texte capte ce qui est dit. Ensemble, ils réduisent les erreurs grossières, comme une phrase polie mais agressive dans le ton, ou une phrase négative prononcée de façon détendue (ex. humour, second degré).

Pipeline type en 2026 : du signal brut à l’action

Dans un scénario réaliste, le flux se déroule en plusieurs étapes. D’abord, une brique de reconnaissance vocale transforme la parole en texte, puis des modèles évaluent simultanément l’émotions audio et le sentiment du verbatim. Ensuite, une couche de fusion pondère les signaux selon la qualité perçue (bruit, confiance de transcription, durée d’énoncé). Enfin, la reconnaissance des sentiments est convertie en actions : routage, alerte superviseur, adaptation des réponses du callbot, ou déclenchement d’un script d’empathie.

Des ressources de vulgarisation illustrent bien cette logique appliquée à la voix, notamment cet éclairage sur l’analyse de sentiment vocal qui met en avant la richesse des indices prosodiques. La valeur, pour un décideur, se mesure à la capacité à relier un score à une décision opérationnelle, pas à la sophistication mathématique.

Ce que mesure vraiment l’analyse des tonalités (et ce qu’elle ne mesure pas)

L’analyse des tonalités s’intéresse aux micro-variations de la voix : montée brusque du pitch, durcissement de l’attaque consonantique, accélération soudaine. Cela peut indiquer une tension, mais pas sa cause. Un client peut parler fort parce qu’il est en colère, ou parce qu’il est dans la rue. D’où l’intérêt d’intégrer le contexte conversationnel : “je n’arrive pas à me connecter” n’a pas le même sens émotionnel que “vous m’avez débité deux fois”.

Une pratique efficace consiste à définir des “moments critiques” dans l’appel : identification, annonce de délai, refus, facturation. À ces moments, l’identification des émotions est plus prédictive et plus utile. L’insight final : une émotion n’est pas un état permanent, c’est une dynamique.

Cette complémentarité audio/texte amène naturellement une question de décideur : comment choisir entre des approches, et comment comparer des solutions sans se perdre dans les promesses marketing ?

Reconnaissance des sentiments : critères de choix, comparatif et pièges à éviter en 2026

Choisir une solution de reconnaissance des sentiments pour la voix revient à arbitrer entre précision, latence, intégration SI et gouvernance des données. Un score émotionnel livré en fin d’appel peut aider à la QA, mais un score en temps réel peut transformer l’expérience : transfert au bon niveau, changement de ton du callbot, assistance au conseiller. Cette différence “temps réel vs différé” structure souvent le cahier des charges.

Tableau comparatif : modes d’analyse et usages typiques

| Approche | Ce qui est analysé | Points forts | Limites | Usages recommandés |

|---|---|---|---|---|

| Analyse vocale (audio seul) | Prosodie, énergie, rythme, pauses | Capte l’émotion même sans mots explicites | Sensible au bruit et au contexte | Détection de tension, escalade, coaching temps réel |

| Traitement du langage naturel (texte seul) | Transcription, intentions, polarité | Comprend le contenu, utile en reporting | Perd l’intonation, dépend de l’ASR | Analyse post-appel, motifs d’insatisfaction, conformité |

| Fusion multimodale | Audio + texte + contexte | Réduit les contresens, meilleure stabilité | Plus complexe à intégrer et calibrer | Routage intelligent, callbot empathique, priorisation |

Liste des questions qui évitent 80% des mauvais choix

- Le modèle sait-il fonctionner sur des appels réels (bruit, chevauchement de voix) et pas seulement sur des enregistrements propres ?

- Le score émotionnel est-il explicable (segments, indicateurs, niveau de confiance) pour faciliter l’adoption ?

- Quels leviers d’apprentissage automatique sont disponibles pour une adaptation au métier (lexique, scénarios, accents) ?

- La latence est-elle compatible avec un usage temps réel (moins d’une seconde sur les signaux critiques) ?

- La gouvernance (rétention, anonymisation, contrôle d’accès) est-elle alignée avec les exigences internes ?

Exemples de briques complémentaires : vidéo, texte, et expériences empathiques

Dans certains parcours, la voix n’est qu’un canal parmi d’autres. Quand une marque analyse aussi des retours vidéo (tests produits, avis filmés), un outil spécialisé peut compléter la vision, comme un analyseur de sentiments vidéo qui exploite les signaux multimodaux. Côté texte, l’analyse de sentiment sur verbatim reste un socle utile pour relier émotions et motifs, à l’image de solutions d’analyse de sentiment orientées transcription.

Enfin, certaines innovations poussent l’empathie plus loin, en cherchant à rendre les assistants conversationnels plus sensibles à la nuance émotionnelle. Pour prendre le pouls de ces tendances, des approches d’IA vocale empathique illustrent la direction du marché : comprendre l’utilisateur pour adapter la posture, tout en gardant une limite claire entre assistance et interprétation psychologique.

À retenir : une solution pertinente n’est pas celle qui promet “toutes les émotions”, mais celle qui relie un petit nombre d’états fiables à des décisions métier mesurables.

Une fois le choix cadré, reste l’étape qui fait la différence : intégrer cette intelligence dans le callbot et dans l’organisation, sans créer de friction. C’est l’objet de la section suivante.

Découvrir AirAgent · Démo personnalisée offerte

Détection des émotions en production : intégration callbot, gouvernance et ROI mesurable

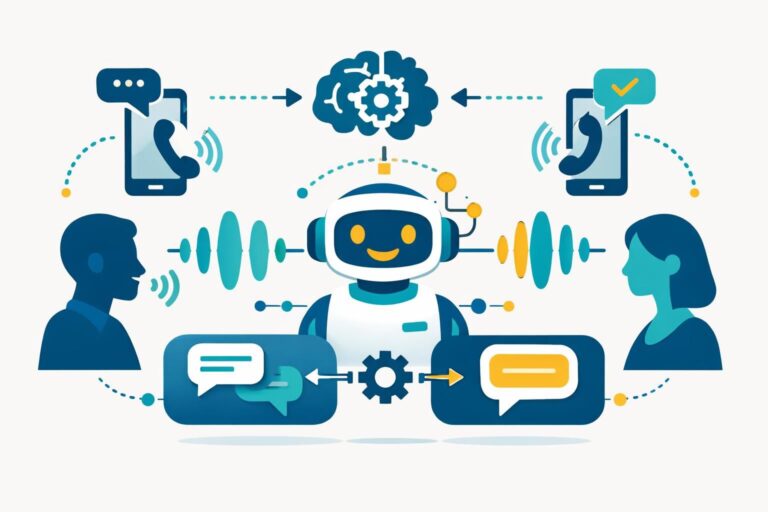

En production, la détection des émotions devient un composant d’un système socio-technique : outils, processus, formation et pilotage. Un callbot qui adapte son discours grâce à l’intelligence vocale peut réduire la perception de “robot froid”, mais seulement si les règles sont cohérentes. Par exemple, un excès d’empathie sur des demandes simples peut sembler artificiel, tandis qu’une posture trop neutre sur une réclamation peut augmenter la frustration.

Intégration : du POC “qui marche” au dispositif qui tient la charge

Un POC réussit souvent sur un échantillon propre, avec des scénarios bien cadrés. La réalité d’un centre de contact impose de gérer la variabilité : appels courts, silences, chevauchements, transferts, changements de langue. Une intégration solide prévoit des garde-fous : seuil de confiance minimal, repli sur une stratégie neutre si la qualité audio baisse, et journalisation des segments pour audit qualité.

Le fil conducteur d’Alphea Énergie illustre un point clé : les actions doivent être simples. Lorsque le score “tendu” apparaît, le callbot peut raccourcir, reformuler, ou proposer une alternative (rappel, SMS de suivi). Lorsque le score “critique” persiste, le transfert devient prioritaire. C’est cette chaîne causale qui rend la reconnaissance des sentiments rentable.

Encadrement éthique et conformité : créer de la confiance interne et externe

La gouvernance est souvent le facteur d’adoption numéro un. Les équipes doivent comprendre ce qui est mesuré et pourquoi. Informer sur l’usage, limiter la conservation, contrôler l’accès aux enregistrements, et éviter l’usage disciplinaire automatique sont des pratiques qui protègent la marque et sécurisent l’adhésion des équipes. Une direction relation client gagne à positionner la mesure émotionnelle comme un outil de service et de qualité, pas comme un “thermomètre individuel”.

Dans le même esprit, les biais doivent être traités méthodiquement : accents, différences culturelles, pathologies vocales, et conditions de bruit peuvent fausser l’identification des émotions. La réponse n’est pas de renoncer, mais d’évaluer par segments de population, de monitorer les dérives, et de permettre un contrôle humain sur les décisions sensibles.

Conseil d’expert : transformer un score émotionnel en KPI opérationnel

Conseil d’expert : plutôt que d’empiler des métriques, définir 2 indicateurs suffit souvent. Le premier peut être la “part d’appels en escalade émotionnelle” (durée cumulée en état critique). Le second, le “taux de désescalade” (retour de critique à neutre après action). Ces KPIs créent un langage commun entre DSI, superviseurs et direction, et rendent l’optimisation continue beaucoup plus tangible.

À retenir : en 2026, l’avantage concurrentiel ne vient pas d’un modèle plus “intelligent”, mais d’une intégration qui déclenche la bonne action au bon moment.

Le panorama ne serait pas complet sans un angle souvent négligé : la sortie vocale elle-même. Car détecter une émotion est une chose, répondre avec le bon ton en est une autre.

Au-delà de l’analyse : voix de synthèse émotionnelle et expérience client réellement cohérente

Une fois l’analyse des sentiments en place, un point devient évident : si le système détecte de la tension mais répond avec une voix monotone, l’utilisateur perçoit une dissonance. C’est ici que la synthèse vocale sensible aux émotions change la donne. L’objectif n’est pas de “jouer la comédie”, mais d’aligner la prosodie du callbot sur l’intention : calmer, rassurer, dynamiser, ou rester sobre.

Quand la synthèse vocale émotionnelle améliore réellement le parcours

Sur des parcours comme la déclaration de sinistre, la perte de carte bancaire, ou un incident technique, une voix légèrement plus lente, avec des pauses naturelles, peut réduire le sentiment d’urgence. À l’inverse, sur une confirmation de rendez-vous ou une information logistique, une tonalité plus vive évite l’impression de robot administratif. Cette adaptation repose sur la même base : analyse vocale, compréhension du texte, et paramétrage du rendu.

Des cas d’usage de synthèse vocale alignée sur l’émotion montrent comment le passage “texte plat → audio expressif” peut être industrialisé, comme la synthèse vocale sensible aux émotions. Le bénéfice est double : cohérence perçue et réduction des reprises, parce que l’utilisateur sent que l’échange progresse au bon rythme.

Mettre des limites : éviter l’effet “trop empathique”

Un callbot qui surjoue l’empathie peut agacer, surtout en B2B ou sur des demandes répétitives. Une règle simple consiste à limiter l’expressivité à certains moments : accueil, reformulation d’un problème, annonce d’un transfert, clôture. Le reste du temps, une voix neutre et claire est souvent la meilleure option. Cela rejoint une logique de design conversationnel : l’émotion est un accent, pas un bruit de fond permanent.

Raccorder émotion et utilité : le test qui ne trompe pas

Le test opérationnel consiste à demander : “Si la voix était neutre, le parcours serait-il moins efficace ?” Si la réponse est non, mieux vaut rester sobre. Si la réponse est oui (désescalade, confiance, compréhension), alors l’investissement se justifie. Une expérience vocale réussie, en 2026, est une expérience qui respecte le temps de l’appelant tout en humanisant les moments critiques.

Pour finir sur un volet directement actionnable, les questions terrain reviennent toujours : précision, déploiement, et bonnes pratiques. Les réponses ci-dessous cadrent l’essentiel.

Quelle différence entre analyse des sentiments et détection des émotions sur la voix ?

L’analyse des sentiments vise généralement une polarité (positif, négatif, neutre) et des nuances liées au contenu. La détection des émotions cherche des états affectifs (frustration, colère, anxiété, joie) en s’appuyant fortement sur l’analyse vocale (prosodie, débit, énergie) et, idéalement, sur le traitement du langage naturel de la transcription. En centre d’appels, les deux sont complémentaires : la polarité aide au reporting, l’émotion aide à l’action temps réel.

La reconnaissance des sentiments fonctionne-t-elle en temps réel sur des appels bruités ?

Oui, à condition de prévoir une architecture tolérante au bruit : segments courts, estimation de confiance, et stratégie de repli si la qualité audio est trop dégradée. Les systèmes les plus robustes combinent émotions audio et signaux textuels, puis déclenchent des actions simples (reformulation, transfert, priorisation) plutôt que des classifications trop fines.

Quels KPI suivre pour mesurer le ROI de l’intelligence vocale émotionnelle ?

Deux KPI suffisent souvent : la part d’appels avec escalade émotionnelle (durée cumulée au-dessus d’un seuil) et le taux de désescalade après action (retour à un état neutre/apaisé). En complément, surveiller le taux de transferts, le taux de rappel, et la satisfaction post-appel permet de relier l’identification des émotions à des résultats business.

Comment éviter les biais dans l’identification des émotions ?

Il faut évaluer par profils et conditions réelles : accents, âges, environnements sonores, pathologies vocales. Une bonne pratique consiste à monitorer les erreurs, recalibrer les seuils, et privilégier des catégories émotionnelles limitées mais fiables. Enfin, garder un contrôle humain sur les décisions sensibles renforce la qualité et la confiance.