Sommaire

- 1 Whisper OpenAI et la transcription vocale : ce qui change pour les agents conversationnels en 2026

- 2 Choisir le bon modèle Whisper : vitesse, VRAM, précision et impact sur l’expérience client

- 3 Déploiement et intégration : de Whisper en Python à la production téléphonique (CTI, CRM, qualité)

- 4 Sécurité, confidentialité et choix cloud vs on-premise avec Whisper pour la reconnaissance vocale

- 5 Cas d’usage : améliorer la performance des assistants vocaux et agents conversationnels grâce à Whisper

- 5.1 Standard téléphonique : qualification, routage, et file d’attente intelligente

- 5.2 Support technique : du récit oral au diagnostic structuré

- 5.3 Exploitation des transcriptions : qualité, conformité et pilotage

- 5.4 Whisper est-il adapté aux environnements bruyants en centre d’appels ?

- 5.5 Quel modèle Whisper choisir pour un callbot avec contrainte de latence ?

- 5.6 Comment connecter la transcription Whisper à un agent conversationnel et au CRM ?

- 5.7 Whisper peut-il être auto-hébergé pour des raisons de confidentialité ?

En bref :

- Whisper d’OpenAI s’impose comme une brique fiable de transcription vocale pour des agents conversationnels capables d’échanger au téléphone en conditions réelles (accents, bruit, débits variables).

- Son approche Transformer “sequence-to-sequence” unifie plusieurs tâches : reconnaissance vocale multilingue, traduction, identification de langue et détection d’activité vocale, ce qui simplifie les architectures.

- Le choix du modèle (tiny à large, plus turbo) conditionne le compromis coûts/latence/précision, donc l’expérience client et le ROI en centre d’appels.

- Le déploiement peut être cloud ou auto-hébergé selon les contraintes de conformité, de budget et de gouvernance des données.

- Une intégration bien pensée avec CTI/CRM et des garde-fous qualité transforme la transcription en levier opérationnel : meilleure compréhension vocale, routage, et automatisation de demandes répétitives.

Dans les centres de contacts, la différence entre une expérience “fluide” et un parcours frustrant se joue souvent sur une brique invisible : la transcription vocale. Quand un appel arrive, l’agent (humain ou automatisé) ne “comprend” pas l’audio ; il consomme du texte, des intentions, des entités. C’est précisément là que Whisper, la technologie de reconnaissance vocale publiée par OpenAI, prend une valeur stratégique en 2026 : elle transforme des flux sonores imparfaits en contenu exploitable par le traitement du langage naturel, puis par des agents conversationnels capables de répondre, qualifier, résumer ou escalader.

Le sujet dépasse la simple dictée. Un callbot qui décroche à 8h03 sur une ligne saturée, avec un client pressé et une connexion mobile moyenne, exige une technologie vocale robuste. Le décideur relation client veut réduire la file d’attente et homogénéiser la qualité ; le DSI veut une intégration stable, sécurisée et monitorable. Whisper, parce qu’il a été conçu comme modèle généraliste et multitâche, offre une base solide pour industrialiser la compréhension en temps réel ou quasi temps réel, du standard téléphonique à l’agent augmenté.

Whisper OpenAI et la transcription vocale : ce qui change pour les agents conversationnels en 2026

Whisper OpenAI n’est pas seulement un moteur de reconnaissance vocale “qui transcrit”. Sa conception relève d’une logique intelligence artificielle moderne : un Transformer *sequence-to-sequence* entraîné pour prédire des séquences de tokens, avec des tokens spéciaux servant de “panneaux de signalisation” indiquant la tâche (transcrire, traduire, identifier la langue, etc.). Concrètement, cela permet de remplacer plusieurs étapes historiques d’une chaîne audio (VAD, langue, ASR, post-traitement) par un modèle unique, plus simple à exploiter et souvent plus robuste en conditions réelles.

Dans un contexte d’agents conversationnels, ce point est déterminant. Un callbot ne peut pas se permettre une détection de langue approximative ou des découpages audio erratiques : chaque hésitation se traduit par des reprises, des “pardon ?”, donc par une baisse de satisfaction. Avec Whisper, la même famille de modèles peut gérer l’identification de langue et la transcription, en gardant une cohérence globale. C’est une nuance technique, mais elle produit un effet métier très tangible : moins de frictions, moins de transferts inutiles, et plus de confiance des équipes dans l’automatisation.

Un modèle multitâche qui simplifie la chaîne audio et améliore la compréhension vocale

Dans beaucoup d’architectures classiques, l’audio passe par un détecteur d’activité vocale, puis un modèle ASR, puis une couche de normalisation, avant d’alimenter le traitement du langage naturel. Chaque maillon ajoute sa variabilité. Whisper, en traitant des fenêtres audio (typiquement 30 secondes avec un mécanisme de glissement) et en produisant une sortie textuelle cohérente, réduit la dette d’intégration. L’équipe technique passe moins de temps à “recoller” des segments et plus de temps à optimiser l’expérience de dialogue.

Pour illustrer, imaginons une PME de services à domicile, “ThermoPlus”, qui reçoit un volume d’appels concentrés le matin. Les clients décrivent des pannes en mélangeant jargon, marques et adresses. Avec une transcription instable, le callbot perd les informations et transfère trop tôt. Avec une transcription plus robuste, l’agent conversationnel capte “chaudière”, “code erreur”, “rue”, “numéro”, ce qui améliore la qualification avant routage. La transcription devient alors un avantage concurrentiel : le standard répond vite et collecte les détails sans épuiser les conseillers.

Où se documenter et comment cadrer l’usage en entreprise

Pour une vision officielle du positionnement et des capacités, la page présentation de Whisper par OpenAI permet d’ancrer les attentes. Pour une approche plus “terrain” sur les usages de reconnaissance automatique, certains retours montrent aussi comment Whisper se comporte dans des scènes bruyantes, ce qui résonne avec les réalités de centres d’appels ; à ce titre, l’exemple de retranscription d’entretiens avec Whisper illustre bien la valeur en conditions non idéales.

Le point clé pour un décideur : Whisper n’est pas une promesse abstraite, c’est une brique mesurable. Les bons KPI ne se limitent pas au taux d’erreur : il faut regarder la réduction de transferts, la baisse du temps de traitement, et la progression du taux de résolution au premier contact. Un insight à garder en tête : la précision utile n’est pas “parfaite”, elle est “suffisante pour décider et agir” dans le flux conversationnel.

Tester AirAgent gratuitement · Sans engagement

Choisir le bon modèle Whisper : vitesse, VRAM, précision et impact sur l’expérience client

Un déploiement réussi repose sur un arbitrage simple à formuler, mais délicat à optimiser : vitesse versus qualité. La famille Whisper propose plusieurs tailles, chacune avec ses exigences matérielles et sa latence typique. Pour des assistants vocaux téléphoniques, la latence est une contrainte directe : au-delà de quelques secondes de délai, l’appelant a l’impression de “parler dans le vide”. À l’inverse, une transcription trop approximative déclenche des incompréhensions, ce qui coûte plus cher qu’une inférence légèrement plus lente. Il faut donc raisonner par scénario : qualification rapide, prise de rendez-vous, support technique, recouvrement, etc.

Les modèles vont classiquement de tiny à large, avec des variantes anglophones “.en” pour certains. Un point pratique en 2026 : les équipes IT cherchent de plus en plus des configurations “sobres” capables de tourner sur une GPU raisonnable, voire sur CPU pour certains lots asynchrones. D’où l’intérêt d’options accélérées comme turbo, optimisée pour transcrire plus vite, avec une dégradation minime de précision pour de nombreux cas. Ce n’est pas un gadget : sur un plateau de relation client, passer de “trop lent” à “acceptable” suffit parfois à rendre l’automatisation viable.

Tableau comparatif des tailles Whisper (repères opérationnels)

Le tableau ci-dessous sert de repère. Les chiffres de VRAM sont des ordres de grandeur ; en production, la performance dépend aussi du débit de parole, de la langue, du bruit et de la pile logicielle. L’important est de relier ces paramètres aux objectifs métier : temps de réponse, volumétrie, coût d’infrastructure.

| Taille de modèle Whisper | Paramètres | VRAM indicative | Vitesse relative (vs large) | Bon usage pour agents conversationnels |

|---|---|---|---|---|

| tiny | ~39M | ~1 GB | ~10x | Qualification rapide, prototypes, appels très courts |

| base | ~74M | ~1 GB | ~7x | Routage simple, intentions limitées, volumes élevés |

| small | ~244M | ~2 GB | ~4x | Standard automatisé polyvalent, meilleure robustesse au bruit |

| medium | ~769M | ~5 GB | ~2x | Support plus technique, multilingue plus exigeant, meilleure stabilité |

| large | ~1550M | ~10 GB | 1x | Qualité maximale, cas complexes, traduction performante |

| turbo | ~809M | ~6 GB | ~8x | Transcription rapide, expérience téléphonique réactive (sans traduction) |

Cas concret : “banque régionale” et stratégie multi-modèles

Une banque régionale fictive, “Crédit Horizon”, gère des demandes variées : opposition carte, solde, rendez-vous, questions sur virement. La stratégie la plus efficace consiste rarement à choisir un seul modèle. Pour la détection d’intention et la réponse rapide (“opposition carte”), un modèle rapide suffit, car le vocabulaire est contrôlé et le dialogue court. Pour des sujets sensibles (“fraude” ou “litige”), une transcription plus précise est préférable, car une erreur de nom propre ou de montant crée un risque opérationnel.

Dans ce type de configuration, l’infrastructure orchestre : un modèle rapide pour la première passe, puis une seconde passe plus robuste si certains signaux apparaissent (bruit élevé, confiance faible, termes critiques). Cette approche protège l’expérience client tout en maîtrisant les coûts GPU. L’insight qui fait la différence : la précision maximale partout est rarement rentable, alors qu’une précision “à la demande” l’est souvent.

À retenir : le “meilleur” modèle Whisper est celui qui respecte vos SLA de latence tout en maintenant une transcription utile pour le traitement du langage naturel et la décision métier, pas celui qui gagne un benchmark hors contexte.

Pour approfondir la logique d’architecture de la reconnaissance en centre d’appels, la ressource reconnaissance vocale et callbots aide à relier performance technique et effets sur la satisfaction. Cette base permet ensuite d’ouvrir la question du déploiement, justement, entre cloud et environnement maîtrisé.

Déploiement et intégration : de Whisper en Python à la production téléphonique (CTI, CRM, qualité)

Mettre Whisper en production ne se résume pas à “lancer une commande”. La valeur apparaît quand la transcription s’intègre à la téléphonie, au CRM et aux règles de dialogue. En pratique, trois couches travaillent ensemble : l’audio (capté via un trunk SIP, un fournisseur de téléphonie ou une plateforme), l’ASR (Whisper) et l’orchestrateur conversationnel (NLU, gestion d’état, génération de réponse). Chaque couche impose ses contraintes : format audio, gestion des silences, temps réel, et surtout observabilité.

Côté outils, Whisper s’installe couramment via *pip* et s’appuie sur *ffmpeg* pour la conversion audio. En entreprise, ce détail devient un sujet de standardisation : images Docker, durcissement, versions validées. Le code est disponible sur le dépôt GitHub de Whisper, utile pour comprendre les options, les modèles et les paramètres d’inférence. Pour des équipes produit, l’approche Python est intéressante car elle accélère la mise en place d’un POC tout en restant proche des contraintes de production.

Du POC au “vrai” callbot : ce que la téléphonie exige

En téléphonie, l’audio n’est pas un fichier propre déposé sur un disque. Il s’agit de flux, souvent compressés, parfois mono, avec une bande passante limitée. La transcription doit donc tolérer les coupures et les variations. C’est ici que l’intégration CTI (couplage téléphonie-informatique) devient centrale : elle fournit le contexte (numéro appelant, file, motif supposé, historique) et permet de décider quand écouter, quand répondre, quand transférer.

Sur callbot-ia.com, l’article CTI et callbot : relier téléphonie et informatique détaille les enjeux d’intégration. Dans un projet Whisper, ce lien est déterminant : une bonne transcription sans contexte est moins utile qu’une transcription “moyenne” mais enrichie de signaux CRM (type de contrat, incidents récents). Les décideurs y gagnent une automatisation plus fine : identification, authentification, et personnalisation.

Encadrer la qualité : normalisation, ponctuation, et “texte utile” pour le NLP

Whisper produit du texte ; le traitement du langage naturel a besoin d’un texte “propre” : nombres normalisés, noms de produits cohérents, segmentation des tours de parole. Sans tomber dans une usine à gaz, quelques règles apportent énormément. Exemple simple : convertir “deux cent cinquante” en “250” avant d’extraire un montant. Autre exemple : reconnaître des adresses dictées et les valider via une base interne, plutôt que d’exiger une transcription parfaite.

Conseil d’expert : pour les parcours critiques, mettre en place une boucle d’amélioration basée sur les appels réels. Une équipe qualité peut taguer 200 conversations par semaine (intention, erreurs, transferts) et alimenter un backlog d’optimisation : prompts, règles métier, gestion des reprises. Le gain est double : hausse du taux d’automatisation et réduction des irritants, sans dépendre d’un “grand soir” technique.

Un insight final pour cette partie : la transcription n’est pas un livrable, c’est un flux vivant ; la performance se pilote comme un service, avec des métriques et des itérations.

Découvrir AirAgent · Démo personnalisée offerte

Pour des démonstrations concrètes d’intégration d’API de transcription et de bonnes pratiques d’implémentation applicative, un guide comme intégrer l’API Whisper dans une application aide à cadrer les étapes. Le sujet suivant, toutefois, s’impose rapidement aux DSI : où traiter l’audio et comment gouverner la donnée.

Sécurité, confidentialité et choix cloud vs on-premise avec Whisper pour la reconnaissance vocale

Dans un centre de contacts, la voix n’est pas un média neutre : elle peut contenir des données personnelles, parfois des informations sensibles (santé, paiement, litiges). Le choix d’architecture autour de Whisper doit donc refléter un équilibre entre vitesse de déploiement et gouvernance. En 2026, la question revient dans presque tous les comités : faut-il envoyer l’audio vers un service cloud, ou traiter en local/privé ? La réponse dépend moins d’une posture idéologique que de contraintes opérationnelles : obligations contractuelles, exigences du RSSI, et capacité interne à maintenir un service.

Whisper ayant été publié en open source (licence MIT), une partie des organisations privilégie l’auto-hébergement : traitement dans un VPC, voire sur site, pour réduire l’exposition des données. D’autres choisissent le cloud pour accélérer l’industrialisation, à condition de cadrer le chiffrement, la rétention et les accès. Dans les deux cas, la sécurité se joue à trois niveaux : transport de l’audio, stockage (si journalisation) et contrôle d’accès aux transcriptions.

Quand l’auto-hébergement devient un accélérateur (et pas une contrainte)

Contrairement à une idée reçue, l’auto-hébergement n’est pas systématiquement “plus lent”. Pour des volumes stables et des exigences strictes, internaliser la brique ASR peut réduire la latence réseau et donner une maîtrise plus fine des logs. Certaines équipes utilisent des builds optimisés, des conteneurs et une orchestration GPU pour servir plusieurs files d’appels. Pour explorer ce sujet de manière pragmatique, le retour sur la transcription Whisper auto-hébergée éclaire les options techniques typiques (CLI, conteneurs, variantes optimisées).

Le point de vigilance : l’auto-hébergement transforme Whisper en produit interne. Il faut monitorer l’usage, gérer les mises à jour, et prévoir une redondance. Un callbot qui “n’entend plus” pendant 20 minutes peut coûter cher en réputation. La bonne approche consiste à traiter ce composant comme un service critique, avec SLO, alerting et plan de reprise.

Réduire le risque : minimisation des données et politiques de rétention

La sécurité n’est pas seulement “technique”. Une politique de minimisation est souvent le meilleur ROI : ne conserver que ce qui sert. Pour un assistant de support, il peut suffire de stocker un résumé textuel et quelques métadonnées (motif, issue) plutôt que l’audio brut. Quand l’audio est nécessaire (litiges, formation), une rétention limitée et un chiffrement au repos deviennent indispensables. Il faut aussi anticiper l’accès : qui peut écouter ? qui peut lire ? comment auditer ?

Pour cadrer ces sujets dans une logique centre d’appels, la ressource sécuriser un callbot et cybersécurité propose un angle opérationnel. L’enjeu est clair : une intelligence artificielle utile ne doit pas devenir une surface d’attaque. La sécurité bien faite, au contraire, rassure les métiers et accélère l’adoption.

La question du cloud : gouverner plutôt que subir

Le cloud apporte une élasticité précieuse lors des pics (campagnes, incidents, saisonnalité). Il permet aussi d’industrialiser l’observabilité. Mais il impose un cadrage : segmentation réseau, clés, et contrats. Pour structurer l’arbitrage, l’article callbot cloud vs on-premise aide à formaliser des critères : coût total, dépendances, et exigences de conformité.

À retenir : le bon choix n’est pas “cloud ou on-premise”, mais un design où la technologie vocale s’aligne sur le niveau de risque acceptable et sur la capacité de l’organisation à opérer le service au quotidien.

Cas d’usage : améliorer la performance des assistants vocaux et agents conversationnels grâce à Whisper

Une fois la brique de transcription vocale stabilisée, la question devient : que faire de ce texte, et comment créer de la valeur rapidement ? Whisper sert de passerelle entre le monde audio et les systèmes métiers. Couplé à un moteur de traitement du langage naturel, il permet de détecter l’intention, d’extraire des informations (adresse, référence, date), puis d’actionner des workflows. Plus la transcription est robuste, plus l’automatisation est confortable. Mais la valeur ne vient pas d’un score technique ; elle vient d’un parcours client mieux conçu.

Standard téléphonique : qualification, routage, et file d’attente intelligente

Dans un standard, l’objectif n’est pas de “tout faire”, mais de trier et accélérer. Whisper aide à capter la raison de l’appel, même lorsque le client parle vite ou s’interrompt. Ensuite, l’agent conversationnel peut orienter : self-service, rappel, transfert vers une équipe spécialisée. En pratique, la combinaison “bonne transcription + bon routage” réduit le temps perdu par les conseillers sur des demandes répétitives.

Un levier souvent sous-estimé consiste à associer transcription et gestion de flux. Une file d’attente peut devenir “intelligente” : prioriser certains motifs, proposer un rappel contextualisé, ou préparer le dossier avant la prise en charge. Pour creuser cet angle, la file d’attente intelligente avec callbot illustre comment la voix devient un signal de pilotage, pas seulement un canal.

Support technique : du récit oral au diagnostic structuré

Dans le support, le client raconte une histoire : “depuis hier”, “ça clignote”, “j’ai déjà redémarré”. L’intérêt de Whisper est de rendre ce récit exploitable. Un agent conversationnel peut demander des précisions, reformuler, puis proposer des étapes. Là où la transcription fait la différence, c’est sur les noms de produits et les codes erreurs. Une approche efficace consiste à enrichir le texte avec un dictionnaire interne (gammes, références) et à valider les correspondances au fil du dialogue.

Dans une entreprise comme “ThermoPlus”, un callbot peut résoudre les pannes simples (purge, remise à zéro) et ouvrir un ticket pour les autres, en incluant un résumé fidèle. Les conseillers récupèrent une demande déjà structurée, ce qui réduit le temps moyen de traitement. L’insight : l’automatisation la plus rentable n’est pas toujours celle qui “répond”, mais celle qui “prépare” mieux l’intervention humaine.

Exploitation des transcriptions : qualité, conformité et pilotage

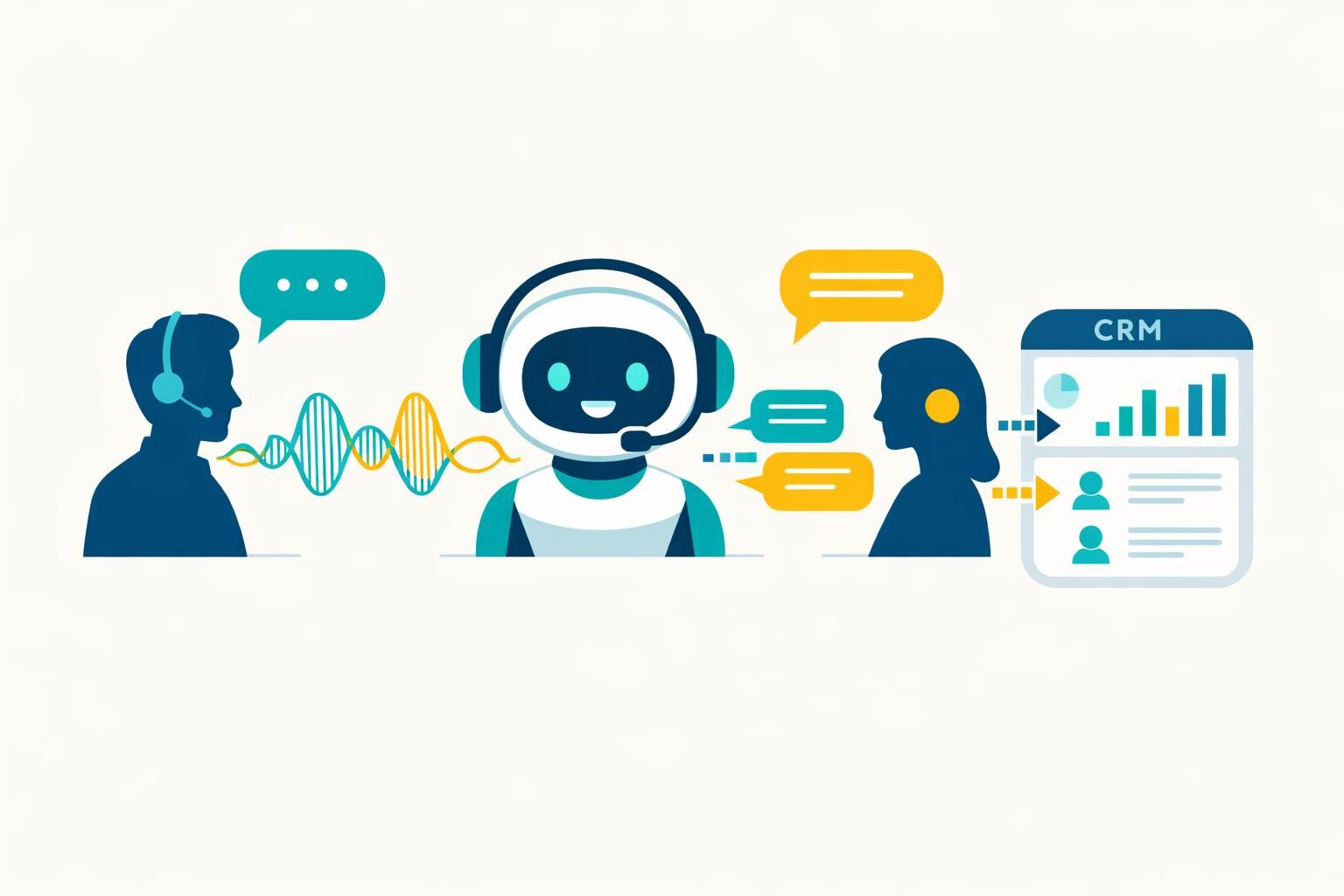

Les transcriptions alimentent aussi la qualité : analyse des motifs, détection de points de friction, et formation. En 2026, les directions relation client cherchent des tableaux de bord actionnables : pourquoi les clients rappellent, quels sujets explosent, quelles formulations déclenchent une incompréhension. L’audio brut est difficile à exploiter à grande échelle ; le texte, lui, se prête à la recherche et à la catégorisation.

Pour aller plus loin sur la chaîne “speech-to-text” appliquée aux callbots, speech-to-text pour callbots détaille les usages et les points d’attention. Une fois cette base acquise, le passage à l’échelle devient une question de méthode : tests, supervision, et amélioration continue.

Une phrase-clé pour clôturer : une bonne transcription ne remplace pas une stratégie relation client, mais elle rend enfin possible une stratégie vocale fiable et industrialisable.

Whisper est-il adapté aux environnements bruyants en centre d’appels ?

Oui, Whisper est généralement robuste face au bruit et aux variations de débit, ce qui en fait une option crédible pour des appels réels. Pour maximiser la qualité, il faut toutefois soigner la capture audio (codec, niveau, mono/stéréo), tester sur des enregistrements représentatifs et choisir une taille de modèle cohérente avec la latence cible. En production, une approche multi-modèles (rapide puis plus précis en cas de faible confiance) améliore souvent l’expérience.

Quel modèle Whisper choisir pour un callbot avec contrainte de latence ?

Pour un callbot, la latence est critique. Le modèle turbo est souvent un bon point de départ pour obtenir une transcription rapide, tout en restant suffisamment précis pour des intentions courantes. Si les appels sont multilingues ou si la traduction est nécessaire, il faut plutôt privilégier medium ou large, puis optimiser l’architecture (mise en cache, traitement par segments, priorisation des motifs) afin de garder un temps de réponse acceptable.

Comment connecter la transcription Whisper à un agent conversationnel et au CRM ?

Le schéma le plus efficace consiste à récupérer l’audio via la téléphonie/CTI, transcrire avec Whisper, puis envoyer le texte au moteur de traitement du langage naturel pour détecter intention et entités. Le CRM fournit ensuite le contexte (client, contrat, incidents) pour personnaliser les questions et les réponses. Enfin, la transcription et un résumé peuvent être écrits dans le CRM comme trace, avec des règles de rétention et de contrôle d’accès alignées avec la politique sécurité.

Whisper peut-il être auto-hébergé pour des raisons de confidentialité ?

Oui. L’open source permet de déployer Whisper en environnement maîtrisé (VPC ou on-premise) afin de réduire l’exposition des données vocales. L’auto-hébergement exige en contrepartie une exploitation sérieuse : supervision, mises à jour, redondance, gestion des clés et des journaux. Pour beaucoup d’organisations, c’est un bon compromis lorsque la voix contient des données sensibles ou que les contraintes réglementaires sont fortes.