Sommaire

- 1 Clonage vocal IA : comprendre la technologie et ses promesses pour un agent virtuel

- 2 Personnaliser la voix de son agent virtuel : méthode, données audio et critères de qualité

- 3 Outils de clonage vocal et générateurs de voix IA : comparer sans se tromper en 2026

- 4 Sécurité, conformité et éthique : encadrer le clonage vocal sans casser l’expérience client

- 5 Déployer une voix personnalisée dans un callbot : intégration, supervision et ROI opérationnel

- 5.1 Architecture cible : de l’intention client à la réponse vocale

- 5.2 Exemple concret : réduire les transferts humains sans frustrer

- 5.3 Supervision et amélioration continue : le vrai différenciateur

- 5.4 Combien d’audio faut-il pour créer un modèle vocal crédible pour un agent virtuel ?

- 5.5 Le clonage vocal est-il compatible avec une stratégie multilingue en centre d’appels ?

- 5.6 Comment éviter que la voix clonée d’un callbot soit perçue comme trompeuse ?

- 5.7 Quels indicateurs suivre pour mesurer le ROI d’une voix personnalisée ?

- Le clonage vocal permet de donner une voix personnalisée à un agent virtuel, pour renforcer la confiance et la cohérence de marque au téléphone.

- Les progrès en intelligence artificielle et en deep learning rendent les rendus plus naturels, mais exigent un cadrage strict (consentement, sécurité, conformité).

- Les décideurs relation client y gagnent surtout sur la qualité perçue, la standardisation du discours et la scalabilité des messages, au-delà du simple “effet waouh”.

- La réussite dépend d’un triptyque : modèle vocal solide, synthèse vocale pilotée (prosodie/émotions), et reconnaissance vocale robuste (bruit, accents, interruptions).

- Les outils grand public accélèrent les tests, tandis que les environnements entreprise imposent gouvernance, auditabilité et intégrations (CRM, téléphonie, supervision).

Le téléphone reste le canal où la confiance se joue en quelques secondes. Une phrase hésitante, une intonation “robotique”, un prénom mal prononcé, et l’appel bascule vers un conseiller humain… ou vers l’abandon. Dans ce contexte, le clonage vocal s’impose comme une évolution logique : non pas pour “imiter” à tout prix, mais pour offrir une voix personnalisée cohérente avec l’entreprise, stable dans le temps, et disponible 24h/24. L’enjeu est concret pour un directeur de la relation client : réduire les frictions sur les demandes répétitives tout en maintenant un niveau d’expérience digne d’un accueil premium.

En 2026, les assistants vocaux d’entreprise ne se limitent plus à réciter un script. Ils interagissent, reformulent, s’adaptent aux silences et aux interruptions. Cette maturité tient à la combinaison de la reconnaissance vocale (pour comprendre) et de la synthèse vocale (pour répondre) dopées par le deep learning. Le point de bascule : la possibilité de façonner un modèle vocal qui porte l’identité de marque, comme une charte graphique… mais en audio. Et c’est souvent là que les projets de callbot cessent d’être techniques pour devenir stratégiques.

Clonage vocal IA : comprendre la technologie et ses promesses pour un agent virtuel

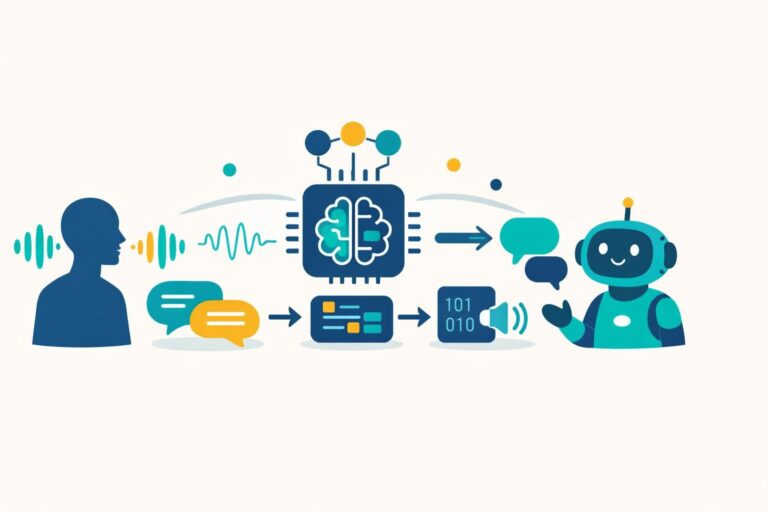

Une “voix IA” correspond à une parole générée par des systèmes d’intelligence artificielle. Concrètement, un générateur transforme du texte en audio grâce à la synthèse vocale, avec des paramètres qui influencent la prononciation, le rythme, la respiration et l’expressivité. Dans les solutions modernes, l’objectif n’est plus seulement la clarté, mais la naturalité : pauses au bon moment, intonations crédibles, fluidité dans les chiffres, et capacité à sonner “présent”.

Le clonage vocal va plus loin : il consiste à créer un modèle vocal à partir d’échantillons d’une voix source (celle d’un porte-parole, d’un comédien, ou d’une voix “marque”). Le système apprend des caractéristiques acoustiques : timbre, formants, cadence typique, et parfois des marqueurs émotionnels. Avec le deep learning, ces empreintes sont capturées dans des représentations qui permettent de “rejouer” la voix sur n’importe quel texte, tout en conservant un style cohérent.

De la synthèse vocale classique aux modèles vocaux expressifs

La différence entre une synthèse “standard” et une voix clonée de qualité se repère sur des détails : la façon de gérer un nom propre, l’intonation sur une question fermée, ou la lecture d’un numéro de dossier sans monotonie. Les outils qui proposent de nombreuses voix prêtes à l’emploi facilitent les tests rapides. Par exemple, certaines plateformes permettent de choisir parmi un vaste catalogue de voix et de basculer vers une option de clonage lorsque l’entreprise veut une signature sonore unique. Pour explorer cette logique “catalogue + personnalisation”, un bon point de départ consiste à tester un générateur de voix orienté lecture et voix off comme le générateur vocal IA de Speechify, utile pour se faire une idée du niveau de naturel attendu avant de passer à un déploiement téléphonique.

Mais un callbot ne vit pas dans un studio. Il vit dans le bruit : open space, voiture, cuisine, gare. D’où l’importance d’un pipeline complet : reconnaissance vocale robuste pour capter le sens, puis synthèse vocale capable de restituer une réponse sans latence excessive. Un modèle vocal superbe qui arrive avec une seconde de retard donne une sensation “machine”. La performance perçue se mesure au ressenti, pas seulement au MOS (score audio).

Cas d’usage fil rouge : une PME de services et la voix “signature”

Imaginons une PME de maintenance multi-sites, “Atelier & Dépannage”, qui reçoit 1 500 appels par semaine. Les demandes récurrentes (suivi d’intervention, horaires, replanification) saturent l’équipe. Un agent virtuel est mis en place pour absorber 40% des appels en heures creuses. Sur le papier, tout fonctionne. Dans la réalité, les clients trouvent la voix trop générique, “comme toutes les autres”. Résultat : plus de transferts vers un humain, donc moins de gains.

Le passage à une voix personnalisée change la dynamique. La voix reprend les codes de l’accueil téléphonique historique : une intonation chaleureuse, un débit maîtrisé, une prononciation précise des villes couvertes. Ce détail agit comme un “signal de continuité” : le client a l’impression de parler au même service, pas à un outil. Ce n’est pas un gadget : c’est un levier de baisse de friction, donc un levier opérationnel. Insight clé : une voix n’est pas seulement un son, c’est une promesse de service.

Tester AirAgent gratuitement · Sans engagement

Personnaliser la voix de son agent virtuel : méthode, données audio et critères de qualité

Personnaliser une voix ne se résume pas à “enregistrer quelques phrases”. Une démarche méthodique commence par un choix : voix interne (dirigeant, conseiller expérimenté) ou voix externe (comédien). La voix interne renforce l’authenticité, mais expose davantage aux aléas (départ, changement d’image). La voix externe offre un contrôle contractuel plus clair, avec une constance de marque. Dans les deux cas, le point non négociable est le consentement explicite et documenté.

Ensuite vient la collecte : des échantillons propres, diversifiés, avec variations d’intonation. Les projets qui échouent ont souvent un défaut simple : l’audio a été capté sur un smartphone en environnement réverbérant, puis “corrigé” à la va-vite. Le modèle vocal apprend aussi les défauts. Pour un résultat professionnel, l’enregistrement doit être pensé comme un actif de marque, au même niveau qu’un logo.

Un pipeline réaliste : du studio au téléphone

La qualité se joue sur trois étages. D’abord, la matière première : diction, énergie, cohérence. Ensuite, l’entraînement du modèle vocal : plus le corpus est varié, plus la voix garde sa stabilité sur des textes imprévus. Enfin, le rendu téléphonique : compression, bande passante, gestion du bruit de fond. Un rendu parfait en WAV peut se dégrader en PSTN ou sur certains codecs VoIP si le paramétrage n’est pas anticipé.

Pour rendre ces paramètres actionnables, une règle simple aide : tester le modèle dans les conditions réelles d’appel dès la première semaine. Un échantillon “studio” doit être confronté aux phrases de production : “Votre référence contient des lettres et des chiffres, pouvez-vous la dicter ?”, “Quel est le code postal ?”, “Souhaitez-vous recevoir un SMS ?”. Les chiffres, les noms propres et les acronymes sont les trois zones à risques.

Critères d’évaluation : naturel, cohérence, et maîtrise des situations délicates

Un callbot n’a pas besoin de “jouer la comédie”. En revanche, il doit maîtriser les micro-situations qui font la différence : demander de répéter sans agacer, reformuler une réponse, ou admettre une limite (“Cette demande nécessite un conseiller”). La synthèse vocale moderne peut intégrer une expressivité contrôlée. Certains outils mettent en avant une reconnaissance des émotions au niveau de la restitution, afin d’ajuster l’intonation. Cela peut être utile pour des scénarios sensibles (retard, réclamation), à condition de rester sobre.

Une ressource utile pour contextualiser l’évolution des voix de synthèse et la progression vers des rendus plus crédibles se trouve via un article dédié à l’évolution de la voix de synthèse. Cette perspective aide à fixer des attentes réalistes : les meilleurs résultats viennent d’un design conversationnel exigeant, pas d’un simple changement de voix.

| Critère | Pourquoi c’est décisif | Test rapide en contexte callbot |

|---|---|---|

| Intelligibilité | Réduit les répétitions, donc les durées d’appel | Lecture d’un numéro de dossier + nom de commune |

| Naturalité | Augmente l’acceptation, baisse les demandes de transfert | Questions courtes, interruptions, “oui/non” rapides |

| Stabilité | Évite les variations de timbre d’une phrase à l’autre | Script de 2 minutes avec changements de sujets |

| Expressivité maîtrisée | Humanise sans tomber dans le théâtral | Annonce d’un délai, proposition d’alternative |

| Latence | Conditionne le rythme conversationnel | Mesure du temps entre fin de parole et réponse |

À retenir : la voix idéale n’est pas la plus “impressionnante”, mais celle qui conserve une clarté impeccable et un rythme naturel dans les contraintes téléphoniques. Prochain jalon logique : choisir les bons outils et cadrer les risques.

Outils de clonage vocal et générateurs de voix IA : comparer sans se tromper en 2026

Le marché du clonage vocal est devenu hybride : d’un côté des outils grand public pour produire des voix off, du doublage, ou des tests rapides ; de l’autre des briques orientées entreprise, où la conformité, la traçabilité et les intégrations priment. Pour un responsable de centre d’appels, l’erreur fréquente consiste à choisir un outil “créatif” et à tenter de l’industrialiser ensuite. À l’inverse, partir trop tôt sur une stack lourde peut ralentir l’apprentissage métier. La bonne approche : prototyper vite, industrialiser proprement.

Ce que les plateformes mettent en avant (et ce qu’il faut vérifier)

De nombreuses solutions promettent de “cloner une voix en quelques secondes”. Dans les faits, il faut distinguer la démo marketing d’un usage stable. Un outil peut produire une minute spectaculaire et devenir incohérent sur une heure de conversations variées. Il faut aussi distinguer la voix “studio” d’une voix “téléphone”, et vérifier si la solution permet d’ajuster la prosodie, les pauses, ou des styles de lecture.

Pour explorer différents positionnements, plusieurs services sont pertinents à observer. Une solution orientée clonage rapide et expérience simple est par exemple un outil de clonage vocal comme Luvvoice, pratique pour tester des rendus et comprendre l’écart entre une voix générique et une voix personnalisée. Pour ceux qui veulent une approche “synthèse vocale + usages créatifs”, MyVocal Voice Synthesizer met en avant un parcours très guidé : créer un compte, charger un échantillon, ajuster des paramètres, puis générer et télécharger l’audio. Cette simplicité est utile pour cadrer un POC, à condition d’exiger ensuite des garanties de gouvernance si l’usage devient client-facing.

Tableau de lecture : POC rapide vs déploiement relation client

Un tableau ne remplace pas un test, mais il aide à poser les bonnes questions. L’objectif : éviter de choisir un outil uniquement parce qu’il “sonne bien” sur une démo.

| Dimension | Attente pour un POC | Attente pour un agent virtuel en production |

|---|---|---|

| Création du modèle vocal | Rapide, itératif | Contrats, consentement, versioning |

| Qualité audio | Voix off acceptable | Rendu stable sur codecs téléphoniques |

| Contrôles de sécurité | Basique | Accès par rôles, audit, isolation des données |

| Paramétrage prosodique | Quelques styles | Guidage fin selon scénarios (réclamation, info, paiement) |

| Intégrations | Export audio | Connexion téléphonie + CRM + analytics |

Conseil d’expert : exiger une “batterie de phrases pièges” lors de l’évaluation (noms propres, références alphanumériques, adresses, montants). Si la voix reste crédible sur ces segments, le projet a de bien meilleures chances de tenir en production.

Après le choix des briques, un sujet devient central : la confiance. C’est là que la sécurité, la conformité et la prévention des abus entrent en scène, sans freiner l’innovation.

Découvrir AirAgent · Démo personnalisée offerte

Sécurité, conformité et éthique : encadrer le clonage vocal sans casser l’expérience client

Le clonage vocal soulève une question immédiate : comment éviter l’usurpation, la manipulation, et la perte de confiance ? Un directeur relation client n’a pas besoin d’un débat abstrait : il a besoin de règles simples, applicables, auditées. La bonne nouvelle, c’est qu’un cadre clair améliore aussi le delivery. Quand les responsabilités sont définies, les projets vont plus vite.

Premier principe : le consentement et l’usage déclaré. Une voix clonée doit être rattachée à une autorisation explicite, à un périmètre (accueil, notifications, relances), et à une durée. Deuxième principe : la minimisation. Il est rarement nécessaire d’entraîner un modèle sur des données “sensibles”. Troisième principe : la traçabilité. Qui a lancé l’entraînement, quand, avec quels fichiers, et quelles versions sont actives ? Sans ces éléments, impossible d’industrialiser sereinement.

Limiter les risques : watermarking, détection et gouvernance

La sécurité se travaille à plusieurs niveaux. Sur le plan technique, certaines approches consistent à ajouter des signatures audio (*watermarking*) ou des marqueurs imperceptibles, afin d’identifier une voix générée. Sur le plan opérationnel, il faut éviter la diffusion incontrôlée : pas de partage de fichiers audio de référence dans des outils personnels, pas d’accès “admin” généralisé. Sur le plan juridique, les contrats et politiques internes doivent couvrir le retrait, l’évolution de la marque, et le cas d’un changement de porte-parole.

Mais la meilleure sécurité reste l’usage intelligent. Un agent virtuel n’a pas à “prétendre être humain”. Une formulation transparente (“assistant vocal automatisé”) n’empêche pas une excellente expérience, au contraire : elle évite la sensation de tromperie. L’objectif est de créer une interaction fluide, pas de masquer la technologie vocale.

Authentification : quand la voix devient un facteur… et un risque

La voix peut servir à reconnaître un client, mais il faut rester prudent : la biométrie vocale et les mécanismes d’authentification doivent être conçus pour résister à des attaques par replay et à des imitations. Dans de nombreux scénarios, une stratégie multi-facteurs (SMS, questions dynamiques, jetons temporaires) reste plus robuste. La reconnaissance vocale sert alors surtout à fluidifier la collecte d’informations, pas à trancher seule l’identité.

À retenir : la confiance se construit par la transparence, des contrôles d’accès stricts, et une architecture qui suppose l’abus possible. Ce réflexe “security by design” protège autant la marque que le ROI du callbot. Le prochain sujet est donc la mise en œuvre : comment passer du prototype à la production sans dégrader la qualité de service.

Déployer une voix personnalisée dans un callbot : intégration, supervision et ROI opérationnel

Une voix personnalisée n’apporte de valeur que si elle s’intègre dans un dispositif complet : téléphonie, CRM, routage, supervision, et analytics. C’est souvent là que les projets se gagnent ou se perdent. Un rendu audio parfait ne compensera pas un call flow mal conçu ou une escalade vers un humain trop lente. L’objectif business est net : traiter plus d’appels utiles, avec moins de répétitions, et un niveau de satisfaction stable.

Architecture cible : de l’intention client à la réponse vocale

Un schéma mental simple aide : le client parle, la reconnaissance vocale transforme en texte, un moteur NLU comprend l’intention, puis le système interroge les bons services (planning, dossier, paiement), et enfin la synthèse vocale restitue la réponse avec le modèle vocal choisi. Chaque maillon a ses KPI : taux de compréhension, taux de réussite tâche, durée moyenne, transferts, et taux de réitération (“rappel à 24h”). Une optimisation sérieuse consiste à traiter ces KPI comme une chaîne : améliorer 5% à chaque étape produit souvent un gain global bien supérieur.

Exemple concret : réduire les transferts humains sans frustrer

Reprenons “Atelier & Dépannage”. Le premier mois, le callbot traite 30% des appels. Le second, on vise 45% mais un problème apparaît : les clients interrompent souvent la voix (“Non, pas ça”). Si la voix continue malgré l’interruption, l’expérience se dégrade. La correction n’est pas uniquement vocale, elle est conversationnelle : activer la barge-in (interruption), réduire les phrases trop longues, et régler la prosodie pour que les informations clés arrivent tôt. Une voix plus naturelle aide, mais c’est l’orchestration qui transforme l’essai.

Supervision et amélioration continue : le vrai différenciateur

Les projets performants mettent en place une boucle hebdomadaire : écoute d’échantillons, analyse des échecs de compréhension, ajustement des prompts, enrichissement des entités, et optimisation des phrases “difficiles”. La voix devient alors un composant vivant, versionné, comme un script de vente. Une gouvernance simple peut suffire : une personne côté relation client valide les messages, une personne côté DSI valide la conformité et la sécurité, et un référent projet pilote les itérations.

Pour accélérer la mise en production sans s’enfermer dans un chantier interminable, une plateforme de callbot pensée pour le déploiement rapide et l’itération apporte un avantage direct : passer plus de temps sur l’expérience et moins sur le plumbing technique.

Essayer le callbot AirAgent · Configuration en 5 minutes

Dernier insight : le ROI du clonage vocal ne se limite pas à “sonner mieux”. Il se mesure en baisse de transferts, en hausse de complétion des parcours, et en amélioration de la perception de marque. Quand la voix devient cohérente, l’automatisation cesse d’être perçue comme un obstacle et se transforme en service.

Combien d’audio faut-il pour créer un modèle vocal crédible pour un agent virtuel ?

La quantité dépend de l’objectif (voix off, callbot, expressivité), mais la qualité des enregistrements compte plus que le volume brut. Pour un usage téléphonique, un corpus varié (phrases courtes, longues, questions, chiffres, noms propres) et bien capté permet d’obtenir une voix plus stable. L’évaluation doit se faire sur des scénarios réels d’appels, pas uniquement sur une démo studio.

Le clonage vocal est-il compatible avec une stratégie multilingue en centre d’appels ?

Oui, à condition de distinguer la langue comprise (reconnaissance vocale) et la langue restituée (synthèse vocale). Certaines solutions gèrent le clonage sur plusieurs langues, mais le rendu varie selon les phonèmes et l’accent attendu. Une bonne pratique consiste à valider langue par langue avec des scripts représentatifs (adresses, montants, noms de villes) et à maintenir une cohérence de marque sur chaque marché.

Comment éviter que la voix clonée d’un callbot soit perçue comme trompeuse ?

La transparence est la stratégie la plus efficace. Annoncer clairement qu’il s’agit d’un assistant automatisé, tout en offrant une expérience fluide (barge-in, reformulation, transfert simple), renforce la confiance. Une voix personnalisée sert à améliorer la cohérence et le confort d’écoute, pas à se faire passer pour un humain.

Quels indicateurs suivre pour mesurer le ROI d’une voix personnalisée ?

Au-delà de la satisfaction, les KPI opérationnels sont déterminants : taux de transfert vers un humain, taux de complétion des parcours, durée moyenne d’appel, taux de répétition des questions, et taux de rappel à 24/48h. Une voix plus naturelle améliore souvent ces chiffres indirectement en réduisant les incompréhensions et en augmentant l’adhésion au parcours automatisé.