Sommaire

- 1 Watson Assistant vs Azure Bot : critères de Comparatif utiles pour une IA Conversationnelle en production

- 2 Watson Assistant : points forts, limites et conditions de réussite pour un Chatbot et un callbot

- 3 Azure Bot : approche plateforme, intégration Microsoft et industrialisation de l’Automatisation

- 4 Tableau Comparatif Watson Assistant vs Azure Bot : fonctionnalités, déploiement, gouvernance et coûts

- 5 Mettre en production une IA Conversationnelle : méthode de déploiement, tests et itérations (Watson Assistant ou Azure Bot)

- 5.1 Choisir un périmètre rentable : la logique 80/20 appliquée au callbot

- 5.2 Tester avant d’exposer : simulation, transcripts, et “garde-fous”

- 5.3 Relier le projet à la téléphonie et aux données : le nerf de la guerre

- 5.4 Watson Assistant convient-il mieux aux secteurs réglementés ?

- 5.5 Azure Bot est-il un bon choix pour une entreprise déjà sur Microsoft 365 et Azure ?

- 5.6 Quels KPI suivre pour mesurer le ROI d’un Chatbot ou callbot ?

- 5.7 Comment éviter une facture imprévisible avec une Plateforme IA conversationnelle ?

En bref

- Watson Assistant vise les environnements exigeants (réglementation, gouvernance, déploiements hybrides), avec une puissance reconnue en Traitement du langage naturel mais un effort projet souvent conséquent.

- Azure Bot séduit les organisations déjà ancrées dans l’écosystème Microsoft, avec une approche très « intégrations + outillage dev », utile quand l’industrialisation et l’observabilité priment.

- Le vrai différenciateur en 2026 se joue sur la prédictibilité des coûts, la vitesse d’itération et la capacité à connecter la connaissance réelle (tickets, CRM, bases internes) plutôt que des FAQ idéales.

- Un Comparatif pertinent doit inclure la voix (standard téléphonique), la sécurité, les connecteurs, le pilotage et le « plan B » humain.

- Pour valider rapidement un cas d’usage callcenter, un POC court et mesuré vaut mieux qu’un déploiement « big bang ».

Quand les files d’attente du support ressemblent à un périphérique saturé un vendredi soir, l’enjeu n’est plus de « faire un Chatbot », mais de bâtir une IA Conversationnelle qui tient ses promesses au téléphone comme sur le web. Dans ce contexte, le duel Watson Assistant vs Azure Bot revient souvent sur la table des décideurs : d’un côté, une plateforme historique d’Intelligence Artificielle orientée grands comptes et secteurs régulés ; de l’autre, une brique conversationnelle qui s’insère naturellement dans l’univers Microsoft, appréciée pour sa logique d’industrialisation. Mais un Assistant virtuel ne se juge pas seulement sur une démo : ce qui compte, c’est la capacité à absorber le langage réel des clients, à se connecter au SI sans casser la production, et à garder une facture compréhensible même quand le volume explose. Le bon choix, en 2026, ressemble moins à un match de fonctionnalités qu’à une décision d’architecture et de conduite du changement, avec des conséquences directes sur le coût par contact, la satisfaction et la disponibilité des équipes.

Watson Assistant vs Azure Bot : critères de Comparatif utiles pour une IA Conversationnelle en production

Un comparatif sérieux commence par un rappel simple : une Plateforme IA conversationnelle n’est pas un gadget, c’est une chaîne de valeur. Elle capte l’intention (via le Traitement du langage naturel), orchestre un dialogue, appelle des systèmes tiers (CRM, ERP, annuaires, outils de ticketing), puis mesure ce qui a été résolu et ce qui doit être transféré à un humain. Sans cette vision bout-en-bout, le risque est de choisir un outil « impressionnant » mais inadapté à la réalité d’un centre de contacts.

Pour garder un fil conducteur concret, imaginons une ETI française, “Alphex”, qui reçoit 25 000 appels mensuels : suivi de commande, changement d’adresse, réclamations, demandes d’attestation. L’objectif n’est pas d’éviter les conseillers, mais de réduire la pression sur les demandes répétitives, tout en offrant un service 24/7 sur les pics (facturation, soldes, incidents). Le comparatif Watson Assistant vs Azure Bot doit alors s’ancrer dans cinq critères décisifs : compréhension du langage réel, outillage de conception, intégrations, déploiement et pilotage.

La compréhension ne se limite pas à reconnaître des intentions. Une IA Conversationnelle crédible doit gérer les formulations floues (“j’ai un souci avec ma livraison”), les rebonds (“non, ce n’est pas ça”), et la contrainte omnicanale : le même client peut débuter sur le chat et reprendre par téléphone. Dans ce paysage, Watson Assistant est réputé performant sur les domaines à vocabulaire dense (assurance, banque, santé) dès lors que l’entraînement et la configuration sont menés sérieusement. L’envers du décor est que cette précision s’obtient rarement “en cliquant”, et qu’un projet peut s’étirer si les données sont dispersées.

Sur l’outillage, la promesse “no-code” est souvent mal comprise. Un constructeur visuel aide à dessiner des chemins, mais la qualité finale dépend de la stratégie de connaissance, des règles métier, des tests et de l’observabilité. C’est typiquement le point où Azure Bot s’illustre dans les équipes IT déjà équipées Microsoft : l’intégration au cycle dev, la supervision et la gouvernance se marient bien avec une approche produit. À l’inverse, des équipes relation client non techniques peuvent préférer une interface plus orientée rédaction et scénarios, à condition qu’un cadre soit posé.

Pour objectiver, il est utile de recouper les retours d’utilisateurs et les comparateurs. Une lecture croisée de comparaisons d’avis entre Azure Bot Service et IBM watsonx Assistant et de retours structurés sur TrustRadius met en évidence un motif récurrent : l’adéquation dépend moins du “niveau d’IA” que de la capacité à intégrer, tester, contrôler et maintenir la solution sans frictions.

Enfin, un critère souvent sous-estimé : la stratégie d’escalade. Un assistant virtuel doit savoir passer la main, avec contexte, vers un conseiller. Sinon, l’automatisation devient une barrière. Un projet réussi se mesure à son taux de résolution, mais aussi à la qualité du transfert et au ressenti client. Cette discipline prépare naturellement le terrain pour analyser les forces spécifiques de chaque plateforme.

Tester AirAgent gratuitement · Sans engagement

Watson Assistant : points forts, limites et conditions de réussite pour un Chatbot et un callbot

Watson Assistant s’inscrit dans une tradition “entreprise” : gouvernance, conformité, précision sur des domaines pointus, et capacité à s’intégrer dans des environnements complexes. Pour des organisations où la donnée est sensible et les processus stricts, cet ADN est rassurant. Mais il impose aussi une exigence : penser la solution comme un produit, pas comme une simple automatisation ponctuelle.

Traitement du langage naturel : la précision au prix d’un vrai travail de préparation

La force historique de Watson Assistant vient de son moteur de compréhension, capable d’absorber des formulations imparfaites et du vocabulaire métier. Dans des secteurs régulés, cette capacité à “coller” au langage des clients est un avantage : un assuré ne demande pas “un sinistre multirisque habitation”, il dit “j’ai eu un dégât des eaux”. L’IA Conversationnelle doit relier ces mondes sans confusion.

Le point d’attention, toutefois, est la matière première. Pour obtenir des résultats stables, il faut des exemples, des transcripts, des tickets, et des règles de désambiguïsation. Si la base de connaissance est pauvre ou obsolète, l’assistant peut devenir hésitant, donc coûteux à corriger après coup. Chez “Alphex”, cela se traduit par une phase initiale d’audit : catégorisation des motifs, qualité des tags, cohérence des réponses, et identification des “zones grises” nécessitant une escalade humaine.

Constructeur visuel : utile, mais pas un substitut à l’ingénierie conversationnelle

Watson Assistant propose un éditeur visuel apprécié des équipes non développeuses pour structurer des flux : questions de qualification, réponses, conditions et redirections. Cela accélère la mise en forme des parcours, notamment quand le service client veut ajuster un texte ou un embranchement sans dépendre d’un sprint IT.

Néanmoins, la vraie difficulté n’est pas de dessiner un arbre, c’est de gérer la conversation réelle. Par exemple, une demande de “changement d’adresse” implique des contrôles (identité, commande en cours, délais de modification) et des exceptions (adresse à l’étranger, point relais). Un bot “qui marche en démo” peut échouer en production si les exceptions ne sont pas traitées. La réussite passe par des ateliers métiers, une politique de tests et une boucle d’amélioration continue.

Déploiement et intégrations : flexibilité appréciable, complexité à anticiper

Un avantage souvent décisif : la flexibilité de déploiement. Watson Assistant peut s’inscrire dans différents environnements cloud ou hybrides, ce qui parle aux DSI qui doivent respecter des contraintes internes de localisation ou de sécurité. Pour un callbot, les connecteurs voix et la gestion des canaux deviennent vite critiques : un parcours vocal exige une latence faible, une gestion des silences, et une stratégie de confirmation (“Vous confirmez le code postal ?”).

Le coût “réel” se joue alors sur l’intégration : authentification, accès CRM, écriture de tickets, consultation d’historique. Beaucoup d’organisations découvrent que la partie conversationnelle n’est que 40% du travail ; les 60% restants sont dans l’orchestration SI et la gouvernance. Une analyse pragmatique de ce type de plateforme est détaillée dans un retour d’expérience sur Watson Assistant, utile pour se projeter sur l’effort et les pièges fréquents.

Au final, Watson Assistant excelle quand l’entreprise accepte l’investissement : données structurées, équipe projet, tests, et pilotage. C’est un choix qui privilégie la robustesse, à condition de maîtriser la mise en œuvre. La question suivante devient logique : que propose l’approche Azure, davantage alignée “framework” et intégrations Microsoft ?

Azure Bot : approche plateforme, intégration Microsoft et industrialisation de l’Automatisation

Azure Bot (souvent associé à l’écosystème Bot Framework) est fréquemment évalué par des équipes IT qui veulent une brique conversationnelle cohérente avec leurs standards de développement, de sécurité et d’exploitation. L’idée n’est pas seulement de lancer un Chatbot : c’est de le versionner, le monitorer, le déployer proprement, et le faire évoluer sans casser l’existant. Dans des organisations déjà outillées Microsoft, ce positionnement peut faire gagner des mois.

Un environnement “build & run” qui parle aux DSI et CTO

L’atout central d’Azure Bot est sa capacité à s’insérer dans une chaîne logicielle : gestion des identités, politiques de sécurité, supervision, logs, et approche DevOps. Concrètement, “Alphex” peut traiter son assistant virtuel comme un composant applicatif : environnements de test, préproduction, puis production, avec des garde-fous. Cette discipline devient précieuse quand l’assistant touche à des opérations sensibles (modification de données client, création d’incident, annulation d’une commande).

Pour cadrer la proposition, la page produit Azure AI Bot Service clarifie l’orientation “bots de qualité professionnelle”, avec un accent sur l’environnement de développement. Ce n’est pas un détail : sur le terrain, la qualité d’exploitation (alerting, traçabilité, performance) conditionne l’adoption interne autant que la qualité du dialogue côté client.

La réalité des intégrations : l’IA conversationnelle n’est utile que connectée

Un bot non connecté répond des généralités. Un bot connecté résout. La différence est radicale : statut de commande, réédition de facture, prise de rendez-vous, réinitialisation d’accès, suivi d’incident. Azure Bot est souvent choisi parce qu’il facilite l’intégration au SI existant via une logique “services” : appeler des APIs, enrichir le contexte, déclencher des actions, puis reprendre la conversation.

Dans un centre d’appels, ces intégrations doivent aussi être pensées pour la voix. Un callbot performant ne lit pas un écran : il dialogue. Cela implique des confirmations intelligentes, une gestion de l’erreur (“je n’ai pas compris, pouvez-vous répéter ?”), et une escalade fluide. Pour approfondir les enjeux spécifiques au téléphone et aux agents dopés à l’IA générative, la ressource GPT et callbot IA en téléphonie aide à poser un cadre concret.

Points de vigilance : effort de conception et responsabilité du design conversationnel

L’approche “framework” a une contrepartie : elle demande souvent plus de maturité produit. Les parcours conversationnels, la tonalité, la clarté des messages et la stratégie de connaissance ne se résolvent pas par le choix d’une plateforme. Un bot peut être très bien intégré et pourtant mal vécu si le langage est sec, si les choix proposés sont trop techniques, ou si la sortie vers un conseiller est compliquée.

Un signe qui ne trompe pas : quand les équipes relation client ne peuvent pas ajuster un texte sans passer par un cycle IT, l’amélioration continue ralentit. Dans les projets les plus efficaces, un duo se forme : le métier garde la main sur le contenu et la logique d’intention ; l’IT sécurise l’intégration, la performance et la conformité. Cette coopération devient l’axe de rentabilité de l’Automatisation.

Pour aller au-delà des discours, un comparatif “côte à côte” est utile, notamment via une analyse Azure Bot vs IBM Watson qui met en perspective les différences de philosophie. La suite logique consiste à objectiver le tout dans un tableau, puis à parler du sujet qui fâche souvent : la tarification et la prévisibilité.

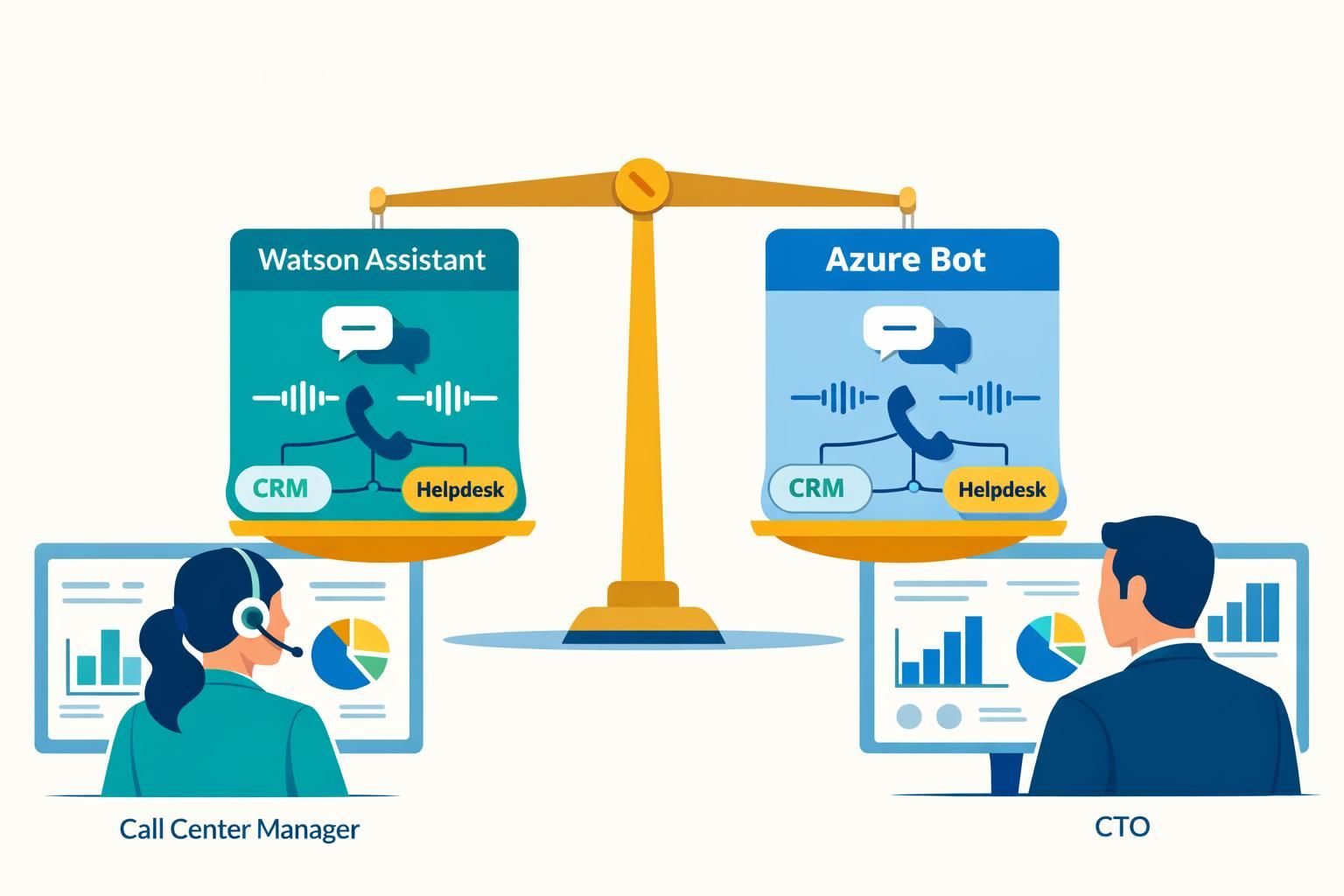

Tableau Comparatif Watson Assistant vs Azure Bot : fonctionnalités, déploiement, gouvernance et coûts

Un tableau ne remplace pas un POC, mais il évite de comparer des “impressions”. Il force à regarder les rubriques qui comptent en production : canaux, intégration, gouvernance, et modèle économique. Les lignes ci-dessous reflètent des différences de positionnement fréquemment observées : Watson Assistant orienté “plateforme enterprise” et Azure Bot orienté “outillage + intégrations”, avec des variations selon l’architecture choisie.

| Critère décisif | Watson Assistant | Azure Bot | Impact opérationnel en centre de contacts |

|---|---|---|---|

| Traitement du langage naturel | Fort potentiel de précision sur domaines métiers, si entraînement et configuration sont solides. | Dépend du design et des services IA associés ; excellent quand l’écosystème Microsoft est bien maîtrisé. | Moins de “je n’ai pas compris” = meilleure satisfaction et moins de transferts inutiles. |

| Conception de dialogue | Constructeur visuel sans code utile pour structurer des flux et impliquer le métier. | Approche plus orientée développement et industrialisation ; nécessite une gouvernance produit. | La vitesse d’itération détermine la capacité à corriger après les premiers appels. |

| Intégrations SI | Intégrations possibles et déploiements flexibles (cloud/hybride), souvent pertinents en environnements réglementés. | Très bon alignement avec les standards Microsoft, pratique pour API, supervision et identités. | Un bot connecté résout ; un bot déconnecté “informe” seulement. |

| Déploiement & conformité | Options d’hébergement et contrôle appréciés par les grandes organisations. | Modèle cloud Azure intégré aux politiques de sécurité et d’exploitation Microsoft. | Réduit les blocages DSI et accélère le passage en production. |

| Tarification & prévisibilité | Modèle perçu comme complexe (variables d’usage, modules), pouvant surprendre lors de pics de volume. | Coûts liés à l’architecture et aux services consommés ; prévisibilité variable selon le design. | Une facture imprévisible fragilise le ROI, surtout lors de campagnes ou pics saisonniers. |

Sur la tarification, Watson Assistant est souvent décrit comme structuré par paliers et métriques d’usage, avec une entrée gratuite limitée et des niveaux payants qui montent avec l’activité. En pratique, l’écueil n’est pas le prix affiché : c’est l’écart entre “prévision” et “réalité” quand un mois connaît une hausse brutale (campagne marketing, incident, période de facturation). À l’échelle d’un centre d’appels, cette volatilité complique le pilotage budgétaire.

Azure Bot, de son côté, peut offrir une trajectoire très cohérente si l’entreprise est déjà structurée pour suivre ses consommations cloud et si l’architecture a été pensée pour éviter les effets de bord. Là encore, le sujet n’est pas “moins cher” ou “plus cher”, mais “maîtrisable” ou “difficile à expliquer” lors d’un comité de direction.

Pour sortir des comparaisons théoriques, une stratégie pragmatique consiste à cadrer un cas d’usage, mesurer un taux de résolution, puis extrapoler. Un bon POC n’essaie pas de tout automatiser ; il vise un motif simple à fort volume, et vérifie si l’Intelligence Artificielle apporte un gain net. À ce stade, beaucoup d’équipes souhaitent aussi tester une alternative plus rapide à déployer, notamment quand le besoin est pressant.

Découvrir AirAgent · Démo personnalisée offerte

Mettre en production une IA Conversationnelle : méthode de déploiement, tests et itérations (Watson Assistant ou Azure Bot)

La réussite d’un projet d’IA Conversationnelle se joue rarement sur la “bonne plateforme” seule. Elle dépend d’une méthode : sélectionner des cas d’usage, structurer la connaissance, tester avec des données réelles, puis itérer vite. Les directions relation client le constatent : un assistant virtuel performant n’est pas celui qui répond à tout, mais celui qui répond parfaitement à quelques motifs critiques, tout en basculant proprement sur un humain pour le reste.

Choisir un périmètre rentable : la logique 80/20 appliquée au callbot

Chez “Alphex”, le premier lot porte sur le suivi de commande et la réédition de facture, car ces motifs sont fréquents et relativement standardisables. C’est aussi une manière de valider l’Automatisation sans toucher immédiatement aux réclamations complexes, où l’empathie et la négociation comptent davantage. Cette stratégie crée un cercle vertueux : moins de bruit sur les demandes simples, plus de temps pour traiter les cas à forte valeur.

À ce stade, la plateforme choisie (Watson Assistant ou Azure Bot) doit prouver deux choses : la qualité de compréhension et la capacité à déclencher des actions (récupérer une commande, générer un document, créer un ticket). Sans actions, le bot reste un “FAQ parlant”, ce qui déçoit vite.

Tester avant d’exposer : simulation, transcripts, et “garde-fous”

Un piège classique consiste à tester seulement en interne, avec des phrases “propres”. Les clients, eux, parlent vite, coupent, mélangent deux sujets, et changent d’avis. Un protocole de test solide s’appuie sur des transcripts réels (appels ou chats), anonymisés, et met l’assistant en situation. L’objectif est de mesurer : taux de compréhension, taux de résolution, temps moyen, et qualité des transferts vers les conseillers.

Un autre garde-fou est la segmentation : certaines intentions restent volontairement “hors périmètre” tant que le niveau de confiance n’est pas suffisant. Par exemple, sur des sujets de paiement, l’assistant virtuel peut se limiter à informer et à aiguiller, plutôt que d’exécuter une action risquée. Cette prudence est souvent ce qui permet de déployer vite, sans crise interne ni irritant client.

Relier le projet à la téléphonie et aux données : le nerf de la guerre

En centre d’appels, l’IA conversationnelle devient vraiment stratégique quand elle s’intègre à la téléphonie, au routage, et aux outils conseillers. L’identification de l’appelant, la récupération du contexte, et la création automatique d’un compte rendu transforment la productivité. Une lecture utile pour cadrer ces sujets est l’extraction de données avec des callbots, car elle montre comment les informations captées deviennent exploitables au niveau opérationnel.

La décision Watson Assistant vs Azure Bot doit donc intégrer un point très terre-à-terre : qui maintiendra les connecteurs, qui monitorera les échecs, et qui pilotera l’amélioration continue ? Quand ces responsabilités sont claires, la technologie devient un levier. Sinon, elle se transforme en dette.

Un indicateur simple permet de juger la maturité : la capacité à publier une amélioration (nouvelle réponse, nouvelle règle, meilleure escalade) en moins d’une semaine. Si l’organisation peut tenir ce rythme, la plateforme, quelle qu’elle soit, aura une chance de délivrer durablement. Dans le cas contraire, il faut réduire l’ambition ou choisir un outil plus “self-service” pour accélérer l’itération.

Watson Assistant convient-il mieux aux secteurs réglementés ?

Oui, Watson Assistant est souvent choisi quand la gouvernance, la conformité et les exigences d’hébergement sont centrales. La contrepartie est un effort projet plus structurant : préparation des données, intégrations SI, tests et pilotage continu pour garantir une IA Conversationnelle fiable.

Azure Bot est-il un bon choix pour une entreprise déjà sur Microsoft 365 et Azure ?

Souvent, oui. Azure Bot s’intègre naturellement aux standards Microsoft (identités, supervision, logique DevOps), ce qui accélère l’industrialisation. Le point clé reste l’organisation : le design conversationnel et la base de connaissance doivent être portés par le métier, sinon l’assistant virtuel progresse trop lentement.

Quels KPI suivre pour mesurer le ROI d’un Chatbot ou callbot ?

Les plus utiles sont le taux de résolution (sans humain), le taux d’escalade, le temps moyen de traitement, la satisfaction après interaction, et le coût par contact. Il est aussi important de suivre la qualité des transferts (contexte transmis, reprise par le conseiller) pour éviter que l’automatisation ne dégrade l’expérience.

Comment éviter une facture imprévisible avec une Plateforme IA conversationnelle ?

La méthode la plus robuste consiste à cadrer un périmètre initial, estimer le volume, instrumenter finement la consommation (par canal et par intention) et définir des seuils d’alerte. Les pics saisonniers doivent être simulés dès le POC pour éviter les surprises, en particulier si la tarification dépend d’indicateurs d’usage.