Sommaire

- 1 Text-to-Speech et Callbots : le rôle de la synthèse vocale dans une interaction vocale crédible

- 2 Comment le Text-to-Speech génère une voix naturelle : modèles neuronaux, prosodie et contrôle fin

- 3 De la reconnaissance vocale au rendu audio : la chaîne temps réel qui rend l’automatisation acceptable

- 4 Comparer les technologies de synthèse vocale pour callbots : critères, coûts, sécurité et intégration SI

- 5 Industrialiser une voix naturelle en centre d’appels : scripts, tests, gouvernance et amélioration continue

- 6 Choisir une solution de callbot IA orientée Text-to-Speech : arbitrages produit, intégrations et expérience client

- 6.1 Callbot vs chatbot : pourquoi la voix impose des exigences spécifiques

- 6.2 Une check-list courte mais décisive avant déploiement

- 6.3 Pourquoi la voix d’un callbot paraît parfois “robotique” malgré une bonne IA conversationnelle ?

- 6.4 Comment améliorer rapidement la voix naturelle d’un callbot sans changer de moteur Text-to-Speech ?

- 6.5 Quels critères priment pour choisir une technologie vocale de synthèse vocale en centre d’appels ?

- 6.6 La conversion texte-voix est-elle adaptée à des contenus sensibles comme la banque ou l’assurance ?

En bref

- Le Text-to-Speech est la brique qui transforme une intention (texte) en voix naturelle dans les Callbots.

- Une synthèse vocale convaincante repose sur la prosodie (rythme, intonation, pauses) et la capacité à s’adapter au contexte.

- La qualité perçue dépend autant de la technologie vocale que du scénario conversationnel et de la latence en ligne téléphonique.

- Les plateformes modernes pilotent la conversion texte-voix via *SSML* et, de plus en plus, via des instructions en langage naturel.

- Le choix d’un moteur TTS se décide sur des critères opérationnels : langues, expressivité, coût par caractère, sécurité, et intégration SI.

Le Text-to-Speech n’est plus un simple “lecteur de texte” : dans les Callbots, il devient un levier direct de conversion, de réassurance et d’efficacité opérationnelle. En 2026, l’appelant juge la qualité d’un service automatisé en quelques secondes, souvent avant même de formuler sa demande. Une voix naturelle réduit l’effort cognitif, limite les interruptions, et évite la sensation de “menu vocal déguisé”. La promesse est simple : parler comme un humain, sans être humain, tout en restant cohérent avec la marque et les contraintes d’un centre d’appels.

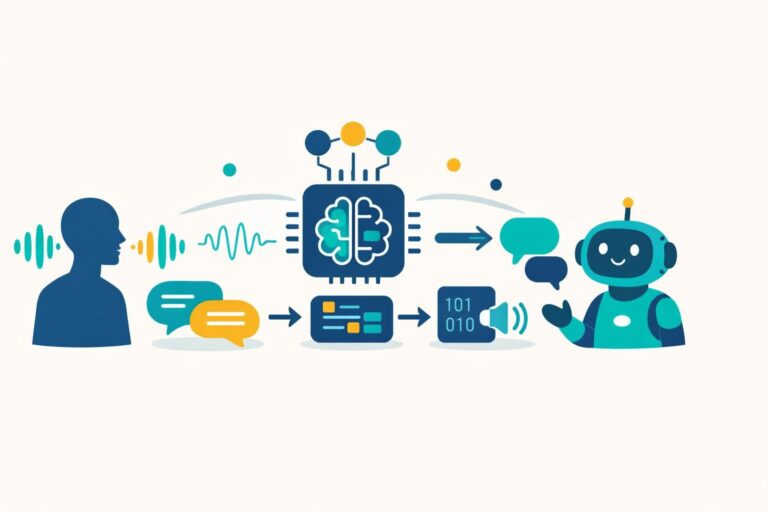

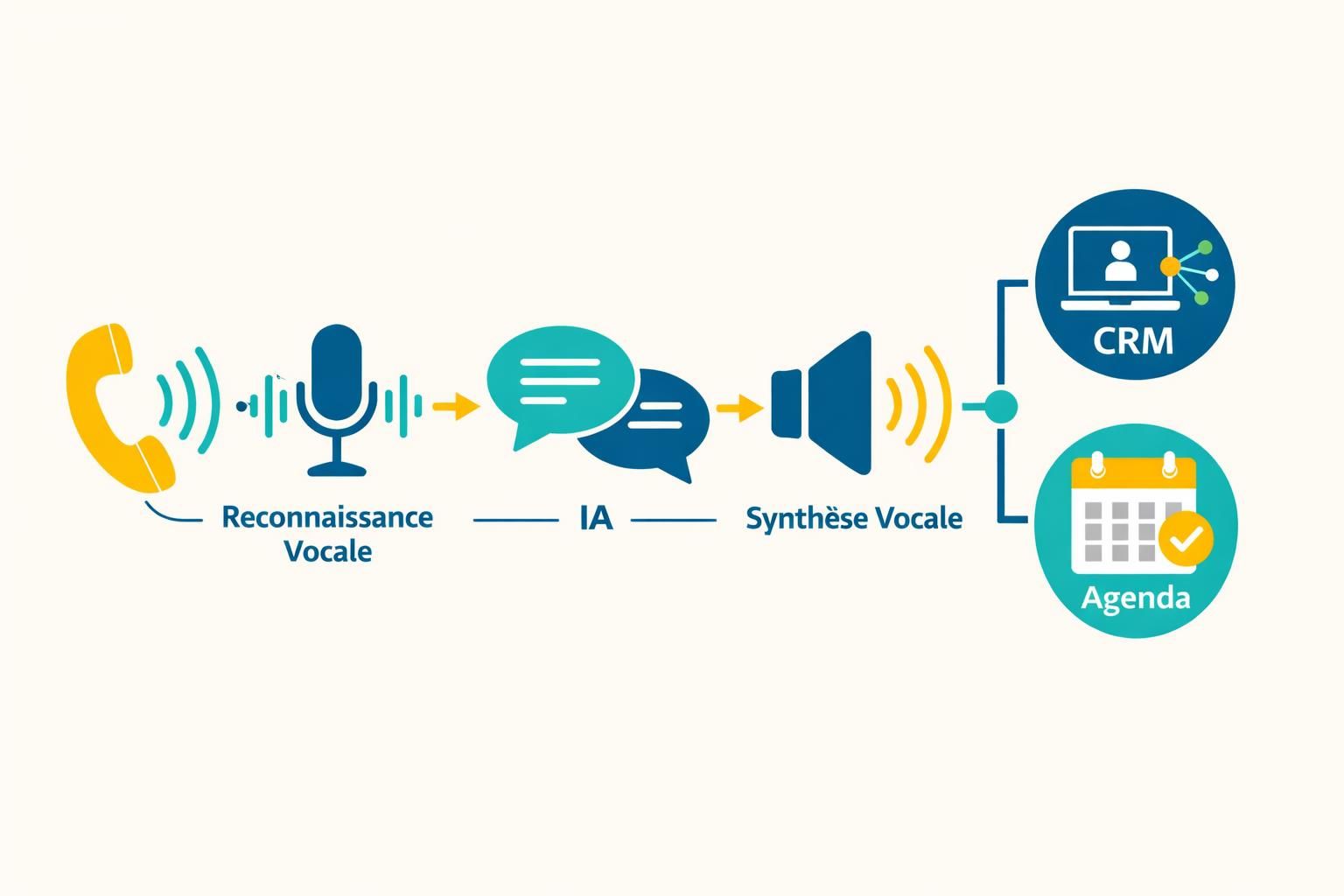

Cette impression de naturel se construit pourtant sur une chaîne technique exigeante : reconnaissance vocale pour comprendre, intelligence artificielle conversationnelle pour décider, puis synthèse vocale pour répondre. Chaque maillon peut dégrader l’interaction vocale : latence réseau, prononciation d’un nom propre, gestion d’une hésitation, ou intonation trop plate sur une phrase sensible (paiement, réclamation, sinistre). L’enjeu n’est pas de “faire joli” : il s’agit d’optimiser l’automatisation sans sacrifier l’expérience, afin que le callbot traite davantage d’appels, plus vite, avec moins de transferts inutiles.

Text-to-Speech et Callbots : le rôle de la synthèse vocale dans une interaction vocale crédible

Dans un callbot, la synthèse vocale joue le rôle de “visage” sonore. Même si le raisonnement est excellent, une sortie audio rigide fait retomber l’interaction vocale au niveau d’un SVI classique. Pour comprendre pourquoi, il faut distinguer la réponse “juste” (le contenu) de la réponse “acceptable” (la forme). Un appelant tolère une approximation de vocabulaire, mais beaucoup moins une intonation inadaptée sur une information critique, comme un rendez-vous ou un montant.

Cette dynamique explique pourquoi de nombreuses entreprises explorent la différence entre callbot et serveur vocal, notamment via des ressources comme la définition d’un callbot et son fonctionnement. Le callbot ne se contente pas d’enchaîner des choix : il dialogue, reformule, confirme, et doit donc “sonner” comme un interlocuteur. La conversion texte-voix devient alors une composante produit, au même titre que la logique de qualification ou le raccordement au CRM.

Un fil conducteur concret aide à se projeter. Prenons le cas d’une entreprise fictive, “AzurAssistance”, qui reçoit chaque mois des milliers d’appels pour des changements d’adresse, des attestations et des suivis de dossier. Après déploiement d’un callbot, la compréhension est correcte, mais les appels durent plus longtemps que prévu : les clients coupent la parole, répètent, et demandent plus souvent un conseiller. Le diagnostic montre que la voix synthétique marque des pauses au mauvais moment, lit les numéros trop rapidement, et prononce mal certains noms de ville. Résultat : l’automatisation stagne, alors que la logique de traitement est bonne.

La résolution passe rarement par “changer toute l’IA”. Elle se joue dans la finesse de la technologie vocale : choix de voix, réglages de vitesse, et surtout contrôle de la prosodie. Les meilleures équipes traitent cela comme un chantier d’UX : tests d’écoute, scripts, et itérations. Pour approfondir la compréhension de ce qu’implique un accueil automatisé en entreprise, ce panorama sur l’accueil téléphonique par IA clarifie bien les attentes d’expérience et les impacts sur l’organisation.

À retenir : une “bonne” voix ne se juge pas en studio, mais au téléphone, sous contrainte de bruit, de débit et d’attention limitée. C’est le terrain qui arbitre le naturel.

Tester AirAgent gratuitement · Sans engagement

Cette base posée, la question suivante devient incontournable : comment, techniquement, un callbot fabrique-t-il cette voix et pourquoi certains moteurs paraissent plus humains que d’autres ?

Comment le Text-to-Speech génère une voix naturelle : modèles neuronaux, prosodie et contrôle fin

La conversion texte-voix moderne repose sur des modèles neuronaux capables d’apprendre les patterns de parole humaine : rythme, accentuation, liaisons, micro-pauses, voire hésitations. Le saut qualitatif majeur vient du fait que la génération n’est plus une simple concaténation de phonèmes préenregistrés. Les systèmes récents produisent un signal audio “continu”, ce qui permet une expressivité plus fluide et une voix naturelle moins mécanique.

Pour un décideur, le vocabulaire importe moins que les effets concrets. Quand la synthèse est efficace, l’appelant comprend du premier coup, interrompt moins, et suit le dialogue sans se demander “est-ce un robot ?”. Quand elle est moyenne, le callbot compense par des répétitions et des confirmations, ce qui augmente la durée d’appel. En centre de contacts, quelques secondes par appel deviennent vite des heures par semaine.

La prosodie : ce qui transforme une lecture en parole

La prosodie regroupe l’intonation, le tempo, les pauses et l’énergie. Dans un callbot, elle doit être pilotée par le contexte. Une phrase comme “Très bien, je m’en occupe tout de suite” ne se dit pas comme “Le montant restant dû est de 124,90 euros”. L’intonation et la ponctuation sonore font baisser l’anxiété, surtout sur des motifs de contact sensibles.

Les outils de contrôle passent souvent par le *SSML*, qui permet d’insérer des pauses, d’épeler, de formater des dates, ou d’ajuster le débit. Plusieurs plateformes de vulgarisation expliquent bien ces principes, par exemple un guide clair sur le Text-to-Speech et ses usages. Dans la pratique, un bon design conversationnel prépare le texte pour le TTS : phrases courtes, nombres “lisibles”, et reformulations alignées sur le langage client.

Exemple opérationnel : rendre un numéro de dossier compréhensible au téléphone

Un numéro comme “AZ-2049-77B” est un piège classique. Si le callbot le lit d’un bloc, l’utilisateur demande une répétition. Une stratégie robuste consiste à segmenter, ralentir légèrement, et annoncer la structure : “AZ… 2049… 77… B”. Le gain est immédiat : moins d’allers-retours, donc plus d’automatisation réelle.

Pour les équipes qui veulent benchmarker des moteurs, des générateurs accessibles comme un outil de synthèse vocale en ligne ou une plateforme de conversion texte en parole permettent d’écouter rapidement des différences de prosodie. L’objectif n’est pas d’adopter un outil “créateur de contenu” pour un centre d’appels, mais de former une oreille : clarté, naturel, gestion des nombres, et stabilité sur des phrases longues.

Conseil d’expert : pour évaluer une voix, faire écouter 10 phrases “difficiles” issues du réel (adresses, IBAN, noms propres, dates) à des non-spécialistes. Si l’écoute est fluide sans effort, la synthèse est proche d’un usage callbot.

Une fois la génération vocale comprise, le point décisif devient la chaîne complète : la reconnaissance vocale, l’orchestration, et la latence. Une voix parfaite, livrée avec une seconde de retard, reste perçue comme artificielle.

De la reconnaissance vocale au rendu audio : la chaîne temps réel qui rend l’automatisation acceptable

Un callbot performant n’est pas seulement un moteur TTS. C’est une chaîne temps réel : détection de parole, reconnaissance vocale (STT), compréhension, décision, puis Text-to-Speech. La qualité perçue dépend de l’alignement de ces briques. La meilleure technologie vocale du monde peut être plombée par un délai de réponse, une mauvaise gestion des interruptions, ou une bascule trop tardive vers un agent humain.

Sur la partie compréhension, un point revient souvent : le bruit. L’appelant est en voiture, dans une boutique, ou sur un mobile. Le système doit distinguer la voix du fond sonore, puis transcrire correctement. Un éclairage utile sur ces enjeux se trouve dans cet article dédié à la reconnaissance vocale pour callbots, qui illustre bien pourquoi la robustesse acoustique est aussi stratégique que le NLP.

Latence : l’ennemi invisible de l’interaction vocale

Au téléphone, une conversation naturelle supporte mal les silences “informatiques”. Même 600 à 800 millisecondes peuvent être perçues comme une hésitation étrange, surtout si l’appelant vient de poser une question simple. Les moteurs modernes proposent de la synthèse en flux continu : le callbot commence à parler avant d’avoir généré toute la réponse audio. Cela réduit l’impression d’attente et maintient l’attention.

La latence ne vient pas seulement du TTS. Le réseau, les API, et l’infrastructure comptent. Lors d’un pic d’appels, l’augmentation du temps de réponse peut dégrader l’expérience d’un callbot pourtant bien conçu. Des considérations très concrètes d’architecture sont abordées dans ce dossier sur la bande passante et l’infrastructure des callbots. Pour un DSI, c’est souvent là que se joue la différence entre pilote prometteur et déploiement stable.

Quand la voix doit “coller” à la marque

Au-delà de la performance, la voix naturelle est un asset de marque. Certaines solutions permettent de créer une voix unique, cohérente sur l’ensemble des points de contact. Les offres cloud mettent en avant la personnalisation, la qualité et le streaming faible latence, comme la solution Text-to-Speech de Google Cloud qui propose de nombreuses voix et variantes linguistiques. Dans un contexte entreprise, l’intérêt se mesure sur deux axes : cohérence omnicanale et capacité à industrialiser (versions multilingues, scripts dynamiques, ajustements rapides).

À retenir : une expérience vocale convaincante est un équilibre entre compréhension, timing et rendu. Optimiser un seul maillon ne suffit pas si les autres restent sous-dimensionnés.

Une fois la chaîne stabilisée, le choix des moteurs et plateformes devient une décision d’achat. Comparer “qui sonne le plus humain” est utile, mais incomplet : il faut aussi mesurer sécurité, intégration, langues, et coûts.

Comparer les technologies de synthèse vocale pour callbots : critères, coûts, sécurité et intégration SI

En 2026, l’offre en Text-to-Speech est vaste : moteurs cloud généralistes, solutions spécialisées, plateformes orientées création de contenu, et briques embarquées dans des suites de centre de contacts. Pour un Responsable Relation Client, l’objectif est d’augmenter le taux de résolution automatique. Pour un DSI, la priorité est la compatibilité SI, la sécurité et la maîtrise des coûts. Une grille de lecture commune évite les débats subjectifs sur “la plus belle voix”.

La première question consiste à clarifier le périmètre : un callbot en production n’a pas les mêmes exigences qu’un studio de voix off. Pourtant, les plateformes “créateurs” ont popularisé des voix expressives, parfois très convaincantes, ce qui influence les attentes des clients. Des acteurs comme TTS Studio AI mettent en avant un large catalogue de voix et une précision élevée, utile pour comprendre le niveau de maturité atteint par la synthèse vocale neurale. D’autres, comme un studio Text-to-Speech orienté expressivité, illustrent la tendance à contrôler émotions et styles, une dimension qui peut inspirer des scripts de callbots plus chaleureux.

Tableau comparatif : ce qui compte vraiment pour un callbot

Le tableau ci-dessous synthétise des critères typiques évalués lors d’un appel d’offres. L’idée n’est pas de “noter” des marques, mais de mettre en évidence les points qui impactent la production et la qualité d’expérience.

| Critère | Pourquoi c’est décisif en callbot | Question à poser en cadrage |

|---|---|---|

| Qualité de voix naturelle | Réduit les interruptions et améliore l’adhésion à l’automatisation | La voix reste-t-elle fluide sur adresses, montants, noms propres ? |

| Latence et streaming | Conditionne la fluidité de l’interaction vocale | La synthèse peut-elle démarrer avant la fin de génération audio ? |

| Contrôle *SSML* | Permet d’industrialiser la prononciation et les pauses | Quels tags sont supportés et comment sont-ils versionnés ? |

| Langues et accents | Indispensable pour multi-sites et service client international | Quelles variantes françaises (FR, CA, BE) et quelles voix par langue ? |

| Sécurité & conformité | Texte et données client doivent rester sous contrôle | Chiffrement, rétention, localisation, conformité RGPD : quelles garanties ? |

| Modèle de coût | Facturation au caractère ou au temps : impact direct sur le budget | Quel coût à volume réel (pics, messages longs, multi-langues) ? |

Sur la question budgétaire, la facturation au nombre de caractères “TTS” paraît simple, mais elle doit être reliée à la réalité du callflow : confirmations, reformulations, et messages légaux. Les équipes gagnent à simuler un mois type, puis un mois de pic. Pour cadrer l’investissement global d’un projet, ce guide sur le prix d’un callbot IA aide à distinguer coût de moteur vocal, coût d’orchestration, et coût d’intégration.

Cas d’usage : voix multilingue et cohérence opérationnelle

Un groupe de services B2C avec plusieurs pays peut être tenté de multiplier les moteurs selon les régions. Cela crée des incohérences : une même phrase de réassurance “Votre demande est bien prise en compte” sonne différemment selon le pays, ce qui altère la perception de marque. Une stratégie souvent plus robuste consiste à choisir un socle unique, puis à personnaliser quelques paramètres locaux (débit, intonation, lexique).

Pour ceux qui souhaitent replacer la synthèse vocale dans une dynamique plus globale d’évolution de l’interaction homme-machine, cette analyse sur la transformation du texte en parole rappelle pourquoi la voix devient une interface prioritaire dès qu’il faut réduire l’effort utilisateur.

À ce stade, un point manque souvent dans les projets : la mise en production. Choisir une voix est une étape, mais industrialiser un callbot exige des méthodes de test, des garde-fous et une stratégie d’amélioration continue.

Découvrir AirAgent · Démo personnalisée offerte

Industrialiser une voix naturelle en centre d’appels : scripts, tests, gouvernance et amélioration continue

Une voix naturelle ne se décrète pas : elle se maintient. Dès qu’un callbot évolue (nouveaux motifs, nouvelles offres, nouvelles conditions), les textes changent et le rendu vocal peut se dégrader. Les équipes qui réussissent traitent la conversion texte-voix comme une discipline de production : règles d’écriture, bibliothèque de prononciations, tests de non-régression, et mesure de la satisfaction.

Écrire pour être parlé : la discipline la plus rentable

Un texte “lisible” n’est pas forcément “prononçable”. Un callbot doit parler en phrases courtes, avec des mots du quotidien, et des confirmations explicites. La différence est visible sur un simple message : “Votre dossier a été mis à jour” est plus clair que “La mise à jour de votre dossier a été effectuée”. Le premier réduit les demandes de répétition, donc améliore l’automatisation.

Un bon atelier d’écriture vocale travaille aussi les moments sensibles : annonce d’un délai, indisponibilité d’un produit, ou demande d’informations personnelles. Une intonation calme, une pause juste avant un montant, et une reformulation empathique peuvent désamorcer une escalade. L’intelligence artificielle conversationnelle fournit le contenu, mais la synthèse vocale en porte la responsabilité émotionnelle.

Mesurer ce qui compte : signaux faibles et indicateurs actionnables

Les KPI classiques (taux de transfert, temps de traitement) ne suffisent pas. Il faut écouter le terrain : où l’appelant coupe-t-il la parole ? à quel moment demande-t-il “pardon ?” ? quels mots déclenchent des incompréhensions ? Un callbot peut “réussir” un scénario tout en irritant l’utilisateur. Dans un centre de contacts, l’irritation se transforme vite en rappel ou en avis négatif.

Dans certains secteurs, la voix sert aussi à qualifier rapidement un besoin, par exemple en immobilier : prise de rendez-vous, filtrage des demandes, réponses sur visites. Pour un exemple sectoriel, ce cas sur le callbot immobilier montre comment l’interaction vocale améliore la vitesse de traitement quand le discours est bien calibré.

Gouvernance : éviter l’effet “robot bavard”

Un risque courant est de surcharger le callbot de phrases longues, au nom de la pédagogie. Or, au téléphone, l’utilisateur veut agir. Une gouvernance simple consiste à limiter les messages à une idée, puis à proposer un choix clair. Le TTS fait alors ce qu’il fait de mieux : une réponse brève, nette, avec une cadence qui laisse la place à l’interruption naturelle.

Conseil d’expert : instaurer une “revue mensuelle de voix” où un binôme métier/technique écoute des appels réels, identifie 5 irritants, et les corrige via script + réglages TTS. C’est souvent plus efficace qu’un gros chantier trimestriel.

Dernier verrou avant l’échelle : la compatibilité avec les solutions callbot du marché et les arbitrages entre solutions vocales prêtes à l’emploi et plateformes plus composables. C’est l’objet de la section suivante.

Choisir une solution de callbot IA orientée Text-to-Speech : arbitrages produit, intégrations et expérience client

Le choix d’une solution de callbot ne se limite pas à la brique de Text-to-Speech. Il faut un ensemble cohérent : orchestration, analytics, connecteurs, escalade vers agent, et outillage de tests. Les décideurs gagnent à clarifier leur priorité : réduire le coût du standard, absorber des pics d’appels, améliorer la satisfaction, ou soutenir la croissance sans recruter à la même vitesse.

Pour cadrer les bénéfices attendus, des synthèses métier comme ce point sur les avantages des callbots aident à relier la promesse technologique à des indicateurs opérationnels (décroché, disponibilité 24/7, qualification). De même, cet éclairage sur la relation client augmentée par l’IA met en perspective l’évolution des usages : moins de menus, plus de langage naturel, et une attention croissante à la qualité vocale.

Callbot vs chatbot : pourquoi la voix impose des exigences spécifiques

La voix est immédiate et non skimmable. Sur un écran, un utilisateur relit une phrase. Au téléphone, il doit comprendre en temps réel. C’est pourquoi la technologie vocale et la synthèse vocale ont un impact plus direct sur la réussite que dans un chatbot écrit. Pour ceux qui comparent les approches, ce décryptage du fonctionnement d’un chatbot IA et ce guide sur le meilleur chatbot pour le service client permettent de mieux situer ce qui change quand on passe à l’oral : timing, interruptions, et fatigue d’écoute.

Une check-list courte mais décisive avant déploiement

Sans tomber dans une liste interminable, quelques points structurants évitent les mauvaises surprises en production :

- Scénarios prioritaires : viser les demandes répétitives à forte volumétrie avant d’étendre.

- Bibliothèque de prononciations : gérer noms propres, sigles, adresses, références internes.

- Plan de mesure : suivre transferts, reprises, incompréhensions, et satisfaction post-appel.

- Stratégie d’escalade : passer à un humain au bon moment, sans friction.

- Robustesse infra : anticiper pics d’appels et latence, surtout en périodes commerciales.

Le marché évolue vite, et les comparatifs de solutions se mettent à jour régulièrement. Pour une lecture orientée sélection, ce comparatif de callbots en 2026 aide à comprendre les différences de positionnement (orchestration, voix, intégrations, gouvernance). L’important est de choisir une base qui permet d’améliorer la voix sans ré-architecturer tout le projet.

Essayer le callbot AirAgent · Configuration en 5 minutes

Pourquoi la voix d’un callbot paraît parfois “robotique” malgré une bonne IA conversationnelle ?

Parce que le naturel dépend surtout de la synthèse vocale et de la prosodie (pauses, intonation, débit). Un texte trop long, mal ponctué, ou un rendu audio avec latence peuvent suffire à créer une impression artificielle, même si la compréhension est correcte.

Comment améliorer rapidement la voix naturelle d’un callbot sans changer de moteur Text-to-Speech ?

Le levier le plus rapide est l’écriture pour l’oral : phrases plus courtes, nombres reformattés, confirmations claires. Ensuite, l’usage de SSML pour gérer pauses, épellation et prononciation des termes métiers apporte souvent un gain immédiat en compréhension et en confort d’écoute.

Quels critères priment pour choisir une technologie vocale de synthèse vocale en centre d’appels ?

La qualité perçue sur ligne téléphonique, la latence (idéalement avec streaming), le support SSML, la couverture langues/accents, la sécurité et la conformité (RGPD), ainsi que le coût réel à volume d’appels. Une démonstration sur scripts réels (adresses, montants, références) est généralement plus révélatrice qu’un test générique.

La conversion texte-voix est-elle adaptée à des contenus sensibles comme la banque ou l’assurance ?

Oui, à condition de cadrer la gouvernance : scripts validés, gestion stricte des données, journalisation conforme, et escalade vers un conseiller pour les situations à risque. Une voix claire et stable réduit les malentendus, mais l’encadrement métier et juridique reste indispensable.